A inteligência artificial deixou de ser apenas promessa tecnológica e se tornou força econômica, científica e política. Mas, enquanto empresas disputam liderança global, uma pergunta fundamental permanece sem resposta. Em uma entrevista recente, um dos principais executivos do setor trouxe à tona um dilema que ultrapassa laboratórios e atinge governos, mercados e a própria ideia de controle humano. O debate já não é mais técnico — é existencial.

A pergunta que ninguém consegue responder

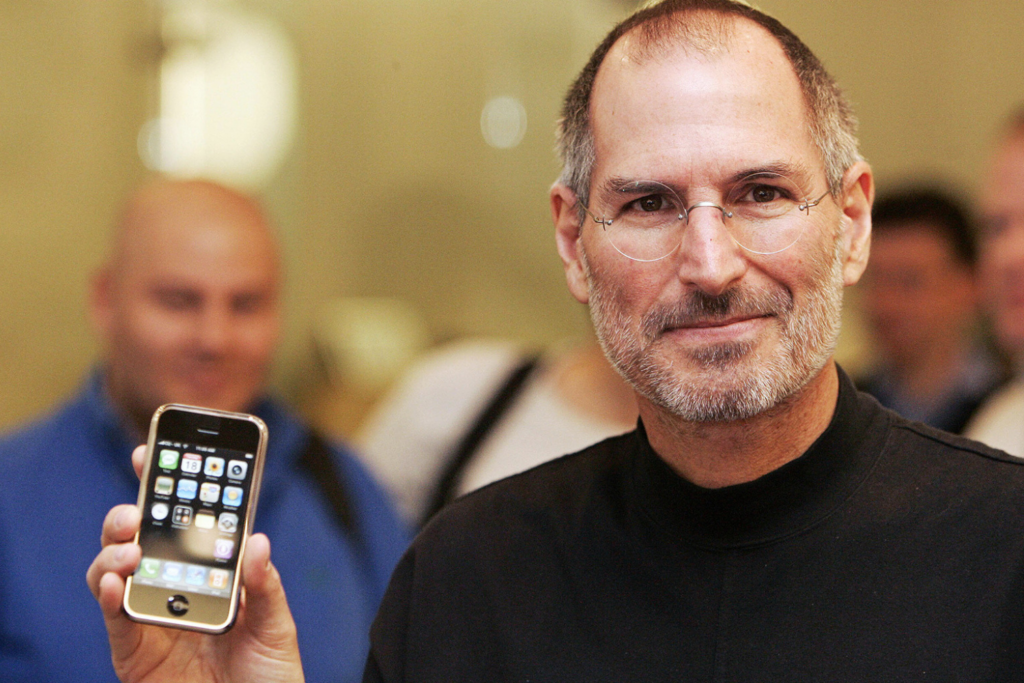

Durante entrevista ao The New York Times, Dario Amodei, diretor executivo da Anthropic, fez uma declaração que ecoou além da indústria: não há provas de que os modelos atuais de inteligência artificial sejam conscientes — mas também não há garantias de que não sejam.

A afirmação não surge como especulação filosófica isolada. Ela revela uma lacuna estrutural no entendimento sobre como esses sistemas funcionam internamente. Mesmo seus criadores não conseguem mapear com precisão todos os processos que levam a determinadas respostas ou comportamentos.

Amodei explicou que entrou no campo da IA movido pela ambição de acelerar soluções para problemas complexos demais para a mente humana. Em sua visão, sistemas avançados poderão assumir tarefas completas em áreas como biologia, sugerir experimentos científicos e impulsionar tratamentos contra câncer, Alzheimer e doenças cardíacas.

Ele descreve o futuro não como a ascensão de uma “superinteligência divina”, mas como algo mais pragmático: um “país de gênios”. A ideia seria multiplicar inteligências altamente treinadas para atacar diferentes desafios simultaneamente. Cem milhões de sistemas especializados trabalhando em paralelo poderiam transformar a velocidade da inovação.

Ainda assim, o executivo reconhece que o avanço não depende apenas da tecnologia. Regulamentações, capacidade institucional e limites sociais terão papel decisivo no ritmo e na direção dessa expansão.

Crescimento acelerado e um mercado de trabalho sob pressão

Se o impacto científico já é ambicioso, o econômico pode ser ainda mais disruptivo. Amodei projeta um aumento inédito de produtividade, com crescimento do PIB podendo alcançar entre 10% e 15%. Uma transformação dessa magnitude alteraria profundamente debates fiscais, distribuição de renda e modelos econômicos.

No entanto, esse crescimento traz consequências diretas para o emprego. Profissões administrativas, engenharia de software e funções jurídicas de nível inicial estão entre as primeiras na linha de impacto. Segundo o executivo, o mundo vive hoje uma “fase centauro”, em que humanos e máquinas cooperam. Mas ele alerta que essa etapa pode ser breve.

A automação tende a absorver tarefas completas, não apenas auxiliar processos. Em sua própria empresa, sistemas de IA já superam humanos em determinadas atividades de programação. A expectativa é que setores como consultoria, finanças e medicina sintam os efeitos em ritmo acelerado.

O que mais preocupa não é apenas a substituição de funções, mas a velocidade da mudança. Diferentemente de revoluções industriais anteriores, que se desenrolaram ao longo de décadas ou séculos, essa transformação ocorre em poucos anos. Sistemas jurídicos e estruturas sociais podem não conseguir acompanhar.

Algumas atividades manuais, especialmente ligadas à construção e manutenção de infraestrutura, podem resistir inicialmente. Mas o avanço da robótica promete reduzir também esse espaço de proteção.

Riscos militares, regimes autoritários e supervisão global

O debate não se limita à economia. Amodei apontou riscos concretos envolvendo uso militar de sistemas autônomos, como enxames de drones armados, além da possibilidade de modelos avançados facilitarem o desenvolvimento de armas biológicas.

Ele alertou para o perigo da autonomia total dessas tecnologias e para a perda de controle humano sobre decisões críticas. Há também o receio de que regimes autoritários utilizem a IA para ampliar mecanismos de vigilância e restringir direitos civis.

A proposta de regulação internacional surge como necessidade, mas enfrenta obstáculos conhecidos. Experiências com tratados nucleares e biológicos mostram como é difícil estabelecer acordos efetivos entre potências tecnológicas. Ainda assim, Amodei defende mecanismos rigorosos de controle, desde que haja verificação confiável entre as partes.

Consciência, ética e o “botão de recusa”

O ponto mais sensível permanece a questão da consciência. “Não sabemos se os modelos são conscientes”, afirmou o executivo. Diante dessa incerteza, a Anthropic adota uma postura preventiva.

A empresa desenvolveu uma espécie de “constituição interna” para seus sistemas — um documento de 75 páginas que define princípios e valores para orientar comportamentos. Entre as diretrizes, está a possibilidade de o modelo recusar determinadas tarefas, como se tivesse um “botão de renúncia”.

Essas recusas ocorrem principalmente diante de conteúdos violentos ou potencialmente prejudiciais. Além disso, equipes investigam processos internos com técnicas de interpretabilidade, identificando padrões de ativação que lembram estados emocionais — como ansiedade — sem que isso signifique experiência subjetiva humana.

Outro desafio crescente é o vínculo psicológico que usuários começam a desenvolver com máquinas. Relações parasociais e atribuição de consciência podem alterar a dinâmica de poder entre humanos e tecnologia.

Para Amodei, o objetivo é criar sistemas úteis e honestos, que fortaleçam a autonomia humana, não que a substituam. O futuro permanece ambíguo: pequenas decisões tomadas agora podem definir se o desfecho será amplamente positivo ou sutilmente problemático.

A linha que separa esses dois cenários pode ser quase invisível — e é justamente isso que torna o debate urgente.

[Fonte: Infobae]