Uma solução simples: reorganizar, não censurar

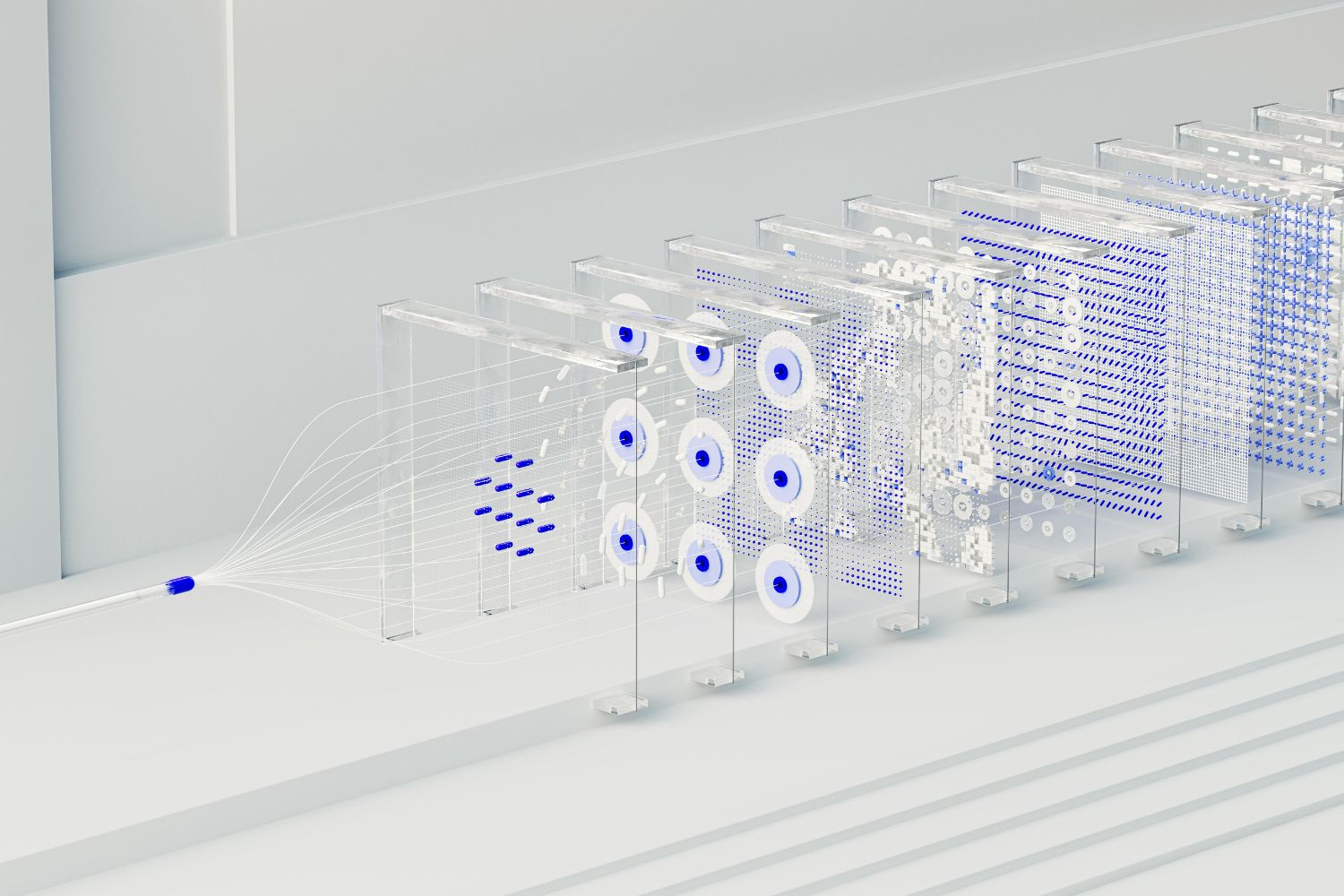

Pesquisadores das universidades de Stanford, Washington e Northeastern desenvolveram uma extensão de navegador com inteligência artificial capaz de reorganizar o feed da rede X (antigo Twitter). A ferramenta empurrava para baixo postagens antidemocráticas ou altamente partidárias, sem removê-las.

A ideia era testar, de forma independente, como mudanças no algoritmo poderiam influenciar a percepção política — e se seria possível reduzir a hostilidade sem afetar a liberdade de expressão.

Como foi o experimento

Mais de 1.200 voluntários participaram do teste durante dez dias, pouco antes da eleição presidencial dos EUA em 2024. Eles foram divididos em dois grupos:

- um viu mais conteúdos polarizadores;

- outro recebeu menos posts hostis, realocados para o fim do feed.

Para medir o impacto, os participantes classificavam seus sentimentos sobre o “lado adversário” em uma escala de 1 a 100. O resultado surpreendeu: quem consumiu menos conteúdo hostil apresentou melhora média de dois pontos.

Pode parecer pouco, mas os autores explicam que o efeito equivale à mudança natural de opinião esperada ao longo de três anos entre os eleitores dos EUA. E funcionou tanto para conservadores quanto para liberais.

Emoções também mudam — mas por pouco tempo

O estudo registrou outro efeito importante: menos raiva e tristeza entre quem viu um feed menos tóxico. Ou seja, reduzir o bombardeio de discursos hostis melhora a convivência digital.

Mas há um porém. Assim que o experimento acabou e o feed voltou ao normal, os sentimentos negativos reapareceram. Os pesquisadores afirmam que isso reforça o poder dos algoritmos: eles moldam o clima emocional online o tempo todo.

Algoritmos mais responsáveis são possíveis

O ponto central do estudo é mostrar que existem alternativas simples para diminuir a polarização. Não é preciso apagar postagens, nem impor filtros rígidos. Só reorganizar o feed já reduz animosidade política — e mantém o usuário livre para ver o conteúdo se quiser.

Para os autores, plataformas poderiam adotar algoritmos mais responsáveis, que deem mais visibilidade a conteúdos construtivos e menos destaque a discursos que inflamam disputas políticas. O ajuste é técnico, mas o impacto é social.

O que ainda falta entender

Como toda boa pesquisa, esta também tem limitações. A extensão só funcionava na versão web do X — não no aplicativo — o que restringe o alcance dos resultados. Além disso, o estudo mediu apenas efeitos imediatos, sem avaliar mudanças duradouras na visão política dos participantes.

Mesmo assim, o experimento deixa um alerta importante: os algoritmos influenciam nossa opinião muito mais do que percebemos. E, com ajustes mínimos, eles também podem ajudar a construir um ambiente online menos tóxico e mais democrático.

[Fonte: Olhar Digital]