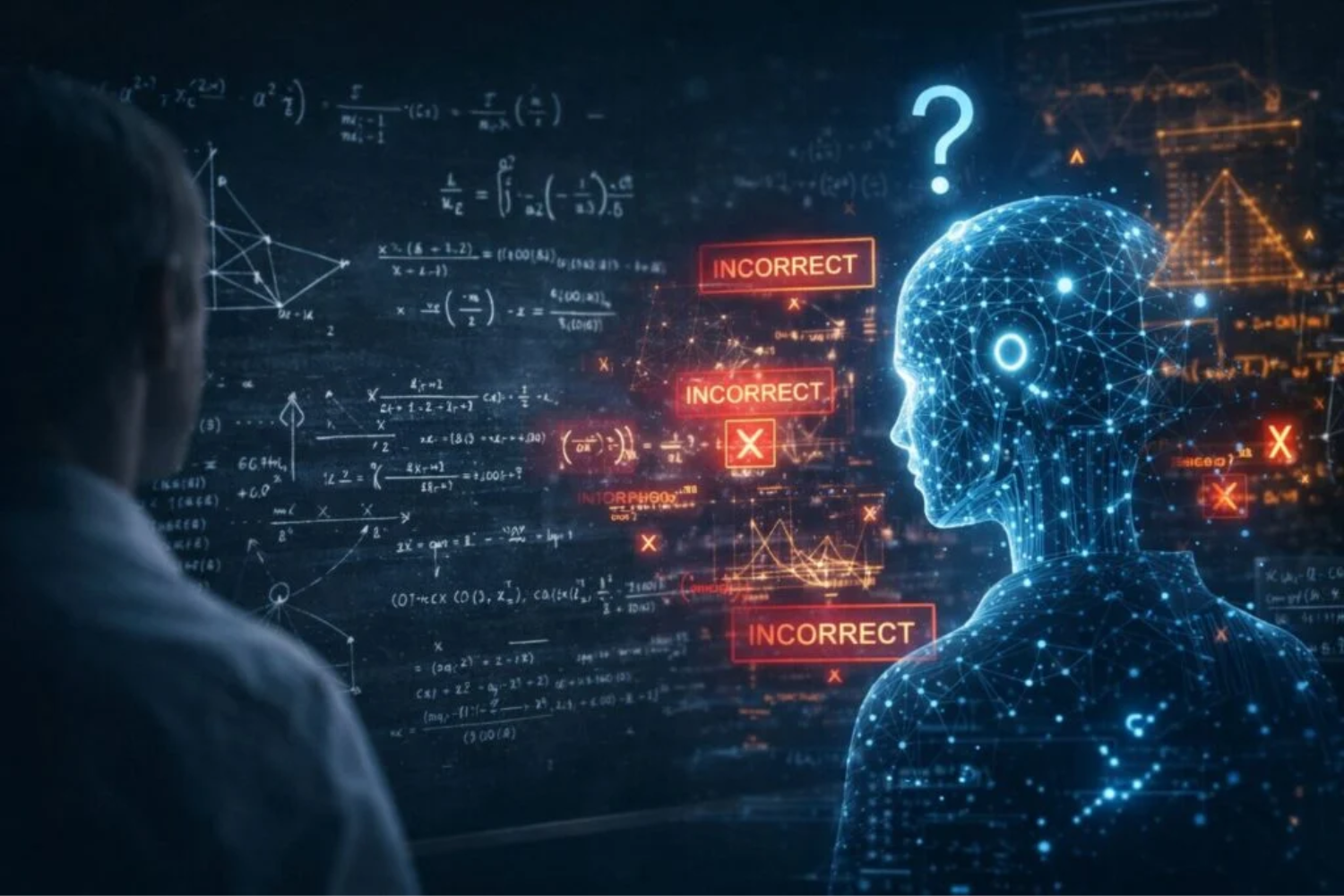

A inteligência artificial evoluiu rápido o suficiente para impressionar até especialistas. Hoje, ela escreve, resolve problemas e até simula raciocínio complexo com naturalidade. Mas por trás dessa aparente sofisticação, surge uma dúvida cada vez mais difícil de ignorar: será que esses sistemas realmente entendem o que fazem? Ou apenas reproduzem padrões aprendidos? Um experimento recente decidiu enfrentar essa pergunta de frente — e os resultados não são exatamente confortáveis.

Um teste criado para expor o que não aparece nas respostas

Durante anos, a maioria dos testes aplicados à inteligência artificial seguiu uma lógica previsível: avaliar sua capacidade de resolver problemas já conhecidos. O problema é que esses desafios, muitas vezes, fazem parte dos próprios dados usados no treinamento dos modelos.

Foi justamente para evitar esse viés que surgiu o projeto First Proof. Idealizado por um grupo de onze matemáticos de elite, o experimento partiu de uma premissa simples, porém radical: testar a IA com problemas que nunca apareceram em lugar nenhum.

Nada de exercícios de olimpíadas ou questões clássicas. Aqui, os desafios vieram diretamente de pesquisas matemáticas ainda não publicadas. Ou seja, não existiam respostas disponíveis, nem caminhos prontos para serem replicados.

A proposta não era verificar apenas se a IA acertava, mas como ela chegava até uma possível solução. Em outras palavras, o foco deixou de ser o resultado e passou a ser o processo.

E foi aí que a diferença começou a aparecer.

Problemas inéditos revelam um limite inesperado

No centro do experimento estavam dez problemas matemáticos reais — do tipo que pesquisadores enfrentam no dia a dia. Nada de enigmas simples ou desafios recreativos. Eram questões que exigiam criatividade, construção lógica e rigor absoluto.

Os modelos de inteligência artificial foram colocados à prova em uma única tentativa por problema, sem dicas, sem contexto adicional e sem possibilidade de ajuste. Era o cenário mais próximo possível de um teste “puro”.

O resultado foi revelador: apenas duas respostas foram consideradas corretas — e mesmo essas levantaram dúvidas sobre sua solidez.

Nos outros casos, o padrão se repetiu. As respostas pareciam convincentes à primeira vista, com linguagem técnica adequada e estrutura lógica aparentemente coerente. Mas, ao serem analisadas por especialistas, mostravam falhas críticas: erros conceituais, saltos lógicos ou argumentos que simplesmente não se sustentavam.

Era como se a IA soubesse “falar matemática” sem realmente dominá-la.

Quando parecer correto não é o mesmo que estar certo

Um dos pontos mais interessantes do estudo foi evidenciar uma confusão comum: a ideia de que escrever bem sobre um tema equivale a compreendê-lo.

Os modelos de linguagem são extremamente bons em gerar textos plausíveis. Eles utilizam símbolos corretos, seguem padrões formais e constroem explicações que soam convincentes. Mas a matemática de verdade não tolera aproximações.

Um único erro em uma cadeia de raciocínio pode invalidar toda a solução. E identificar esse erro exige um nível de compreensão profunda que, por enquanto, parece escapar às máquinas.

Em vários casos, os pesquisadores identificaram o que chamaram de “alucinações matemáticas”: trechos que pareciam corretos, mas introduziam conceitos inexistentes ou aplicavam teoremas de forma incorreta.

Isso levanta uma questão importante: até que ponto podemos confiar em respostas que soam certas, mas não foram realmente compreendidas?

O gargalo invisível continua sendo humano

Outro aspecto que chamou atenção foi o papel dos próprios matemáticos no processo. Mesmo com a ajuda da IA, a validação das respostas continuou sendo totalmente humana.

Cada tentativa gerada pelas máquinas precisou ser revisada com cuidado — um processo lento, detalhado e que exige alto nível de especialização.

Isso revela um limite pouco discutido: a inteligência artificial pode produzir respostas em grande escala, mas verificar se essas respostas estão corretas ainda depende de pessoas.

Em áreas como a matemática, isso não é um detalhe. Uma solução não pode ser “quase certa”. Ou funciona perfeitamente, ou está errada.

E detectar essa diferença continua sendo uma tarefa essencialmente humana.

O que esse experimento realmente diz sobre o futuro

O projeto First Proof não aponta que a inteligência artificial seja inútil — longe disso. Pelo contrário, reforça seu enorme potencial como ferramenta de apoio.

A IA pode sugerir caminhos, explorar possibilidades e acelerar processos de investigação. Mas o experimento deixa claro que existe uma fronteira importante: criar conhecimento novo, em contextos inéditos, ainda parece exigir algo que vai além de padrões aprendidos.

Os próprios criadores do teste pretendem repetir o experimento no futuro, acompanhando a evolução dos modelos. Talvez, com o tempo, essa diferença diminua.

Ou talvez descubramos que existe uma distinção mais profunda entre “responder bem” e “pensar de verdade”.

Por enquanto, o resultado funciona como um alerta: a inteligência artificial pode impressionar — mas isso não significa que ela compreenda.

E essa pode ser, justamente, a diferença mais importante de todas.