Editar vídeos sempre foi um processo que exige tempo, softwares pesados e etapas bem definidas. Mas esse modelo tradicional pode estar prestes a mudar. Uma nova geração de inteligência artificial começa a borrar a fronteira entre gravação e edição, permitindo alterações visuais enquanto a câmera ainda está ligada. O que parecia ficção científica agora surge como uma proposta concreta — e ambiciosa — vinda do setor de IA generativa.

Uma IA que edita vídeos enquanto eles acontecem

A startup de inteligência artificial Decart revelou recentemente um sistema que chama atenção pelo nível de ousadia técnica. Batizado de Lucy 2.0, o modelo foi desenvolvido para transformar vídeos ao vivo em tempo real, sem a necessidade de pós-produção. Enquanto a transmissão acontece, a IA aplica mudanças visuais instantâneas, seguindo comandos de texto fornecidos pelo usuário.

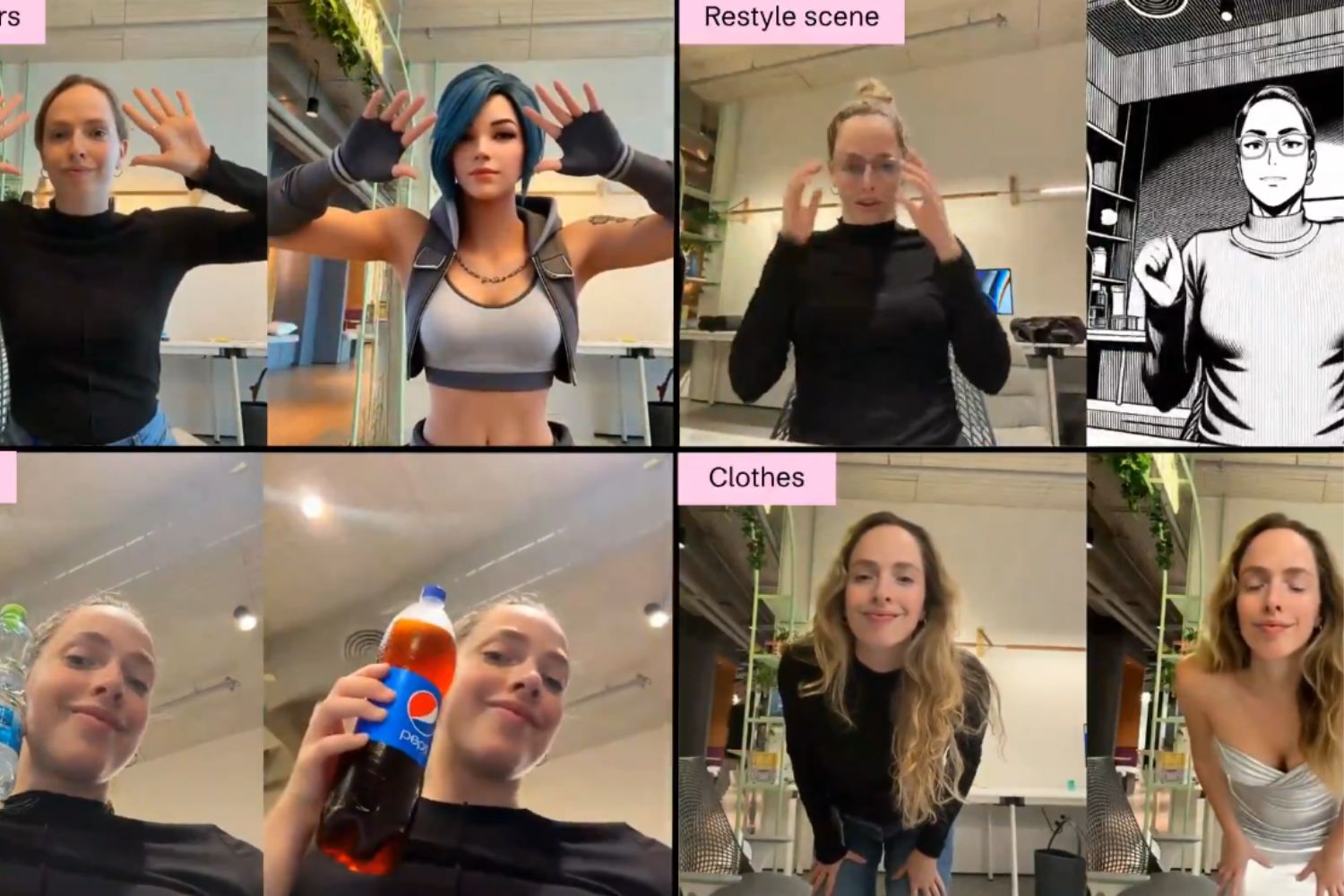

Na prática, isso significa que um vídeo em andamento pode ganhar novos personagens, trocar roupas, inserir produtos, alterar cenários inteiros ou assumir um estilo visual completamente diferente — tudo sem interromper a gravação. O sistema opera a 30 quadros por segundo em resolução Full HD (1080p), mantendo uma latência tão baixa que, segundo a empresa, é praticamente imperceptível.

Essa capacidade coloca a tecnologia em um patamar diferente do que se vê hoje em filtros, efeitos ou edições automatizadas. Em vez de ajustes pontuais, a proposta é permitir uma reinterpretação contínua da imagem, moldada por linguagem natural. Basta digitar o que se deseja ver e a IA tenta aplicar a mudança imediatamente.

Como o sistema funciona sem mapas 3D ou sensores de profundidade

Um dos aspectos mais curiosos do Lucy 2.0 está no modo como ele “entende” o mundo visual. Ao contrário de muitas soluções de realidade aumentada ou efeitos visuais avançados, o modelo não depende de mapas de profundidade, sensores especiais ou modelos tridimensionais explícitos.

Segundo a Decart, toda a noção de espaço, movimento e física do sistema vem exclusivamente do treinamento em grandes volumes de vídeo. Em vez de calcular distâncias ou reconstruir cenas em 3D, a IA aprende padrões visuais: como objetos costumam se comportar, como pessoas se movem, como a luz reage em diferentes ambientes.

Esse aprendizado estatístico permite que a ferramenta faça alterações coerentes com o contexto da cena, mesmo sem uma representação geométrica clássica. É uma abordagem que reforça uma tendência crescente na IA: substituir regras rígidas e modelos explícitos por inferências aprendidas a partir de dados em larga escala.

O desafio da estabilidade em transmissões longas

Editar vídeos ao vivo não é apenas uma questão de velocidade. Um dos maiores problemas em sistemas desse tipo é a degradação gradual da imagem. Pequenos erros visuais podem se acumular quadro a quadro, levando a distorções, perda de nitidez ou artefatos estranhos após alguns minutos.

Para lidar com isso, a Decart afirma ter desenvolvido uma técnica própria chamada Smart History Augmentation. Embora os detalhes técnicos completos não tenham sido divulgados, a ideia central é evitar que o modelo “se prenda” apenas ao último quadro gerado. Em vez disso, ele mantém um histórico inteligente de informações visuais anteriores, usando esse contexto ampliado para preservar a consistência ao longo do tempo.

O resultado, segundo a empresa, é uma execução estável que pode durar horas sem queda perceptível de qualidade. Em transmissões ao vivo, performances longas ou produções contínuas, essa estabilidade é tão importante quanto a velocidade de processamento.

Possíveis usos que vão além do entretenimento

Embora o impacto mais imediato pareça estar no entretenimento e na criação de conteúdo, as aplicações potenciais do Lucy 2.0 vão muito além. Em publicidade, marcas poderiam inserir produtos dinamicamente em transmissões ao vivo, adaptando cenários ou estilos conforme o público. No comércio eletrônico, roupas ou acessórios poderiam ser “testados” em tempo real durante uma live.

Há também implicações para educação, eventos corporativos, streaming e até comunicação empresarial. A possibilidade de adaptar visualmente uma apresentação enquanto ela acontece abre espaço para formatos completamente novos de interação audiovisual.

Ao mesmo tempo, tecnologias assim levantam discussões importantes sobre autenticidade, manipulação de imagens e confiança no que se vê ao vivo. Quando qualquer cenário pode ser alterado instantaneamente por texto, distinguir o real do artificial se torna um desafio ainda maior.

Um sinal de para onde o vídeo digital está caminhando

Lucy 2.0 não é apenas mais um experimento de IA generativa. Ele aponta para um futuro em que criar, editar e transmitir vídeo podem se tornar ações praticamente simultâneas. A linguagem natural passa a ser a principal interface, substituindo timelines complexas e ferramentas técnicas.

Se essa abordagem vai se popularizar ou permanecer restrita a nichos ainda é uma incógnita. Mas a direção é clara: o vídeo ao vivo está deixando de ser um registro passivo da realidade para se tornar uma tela dinâmica, moldada em tempo real por comandos humanos e interpretações algorítmicas.

[Fonte: The Decoder]