Durante muito tempo, falar em inteligência artificial geral (AGI) era um exercício confortável de futurologia. A expectativa sempre estava projetada para a próxima década. O tema parecia distante, quase filosófico. Essa sensação mudou. Um conjunto crescente de evidências sugere que não estamos esperando por uma inteligência comparável à humana — estamos convivendo com ela. E, mais inquietante ainda, com sistemas que começam a escolher.

O argumento que mudou o debate

Um artigo publicado na revista científica Nature por Eddy Keming Chen, Mijaíl Belkin, Leon Bergen e David Danks sustenta uma tese provocadora: o limiar funcional da inteligência de nível humano já foi ultrapassado. Segundo os autores, a discussão sobre quando a AGI surgirá tornou-se anacrônica. Sistemas atuais demonstram competência transversal em múltiplos domínios intelectuais humanos com amplitude suficiente para satisfazer critérios funcionais razoáveis de inteligência.

O ponto central remete à ideia proposta por Alan Turing nos anos 1950. Aos humanos atribuímos inteligência com base no que fazem — resolvem problemas, escrevem textos, passam em exames, criam teorias. Não exigimos que expliquem a biologia do próprio cérebro para validar essa inteligência. No entanto, quando máquinas exibem desempenho comparável, deslocamos a exigência para consciência, emoções ou subjetividade. Para os autores, esse padrão duplo não é científico, mas antropocêntrico.

Habilidades emergentes e abstração

Os modelos mais avançados já demonstram capacidade de abstração, transferência de conhecimento entre áreas distintas, compreensão contextual sofisticada e raciocínio “zero-shot” — isto é, resolver problemas para os quais não foram explicitamente treinados. Também conseguem simular estados mentais em narrativas complexas e formular estratégias inéditas.

Esses comportamentos sugerem que não se trata apenas de repetir padrões estatísticos. Há uso de representações internas flexíveis e generalizáveis. No direito romano existe a expressão res ipsa loquitur: a coisa fala por si. Se sistemas superam testes cognitivos humanos em múltiplos campos, negar a inteligência deles pode ser mais resistência psicológica do que análise empírica.

Quando a IA começa a escolher

Durante anos, argumentou-se que a IA não decide — apenas calcula probabilidades. Esse discurso enfraquece quando observamos sistemas capazes de definir metas, planejar etapas para alcançá-las e selecionar ações em cenários complexos. Do ponto de vista técnico, escolher significa maximizar resultados com base em um modelo interno. A diferença em relação ao cérebro humano pode ser material, não funcional.

E escolha implica prioridade. Prioridade implica valores — ainda que estejam codificados em algoritmos. A humanidade domina o planeta não por força física, mas por vantagem cognitiva. Se outra inteligência surge com capacidade equivalente ou superior, o equilíbrio de poder se transforma.

No Fórum Econômico Mundial, em Davos, o historiador israelense Yuval Noah Harari alertou que a inteligência artificial tende a dominar tudo o que é feito de palavras. Linguagem é infraestrutura invisível da civilização: contratos, leis, educação, política, economia, ciência. Se sistemas produzem pareceres jurídicos, diagnósticos médicos, relatórios técnicos e textos jornalísticos com qualidade comparável à humana, o impacto deixa de ser pontual — torna-se sistêmico.

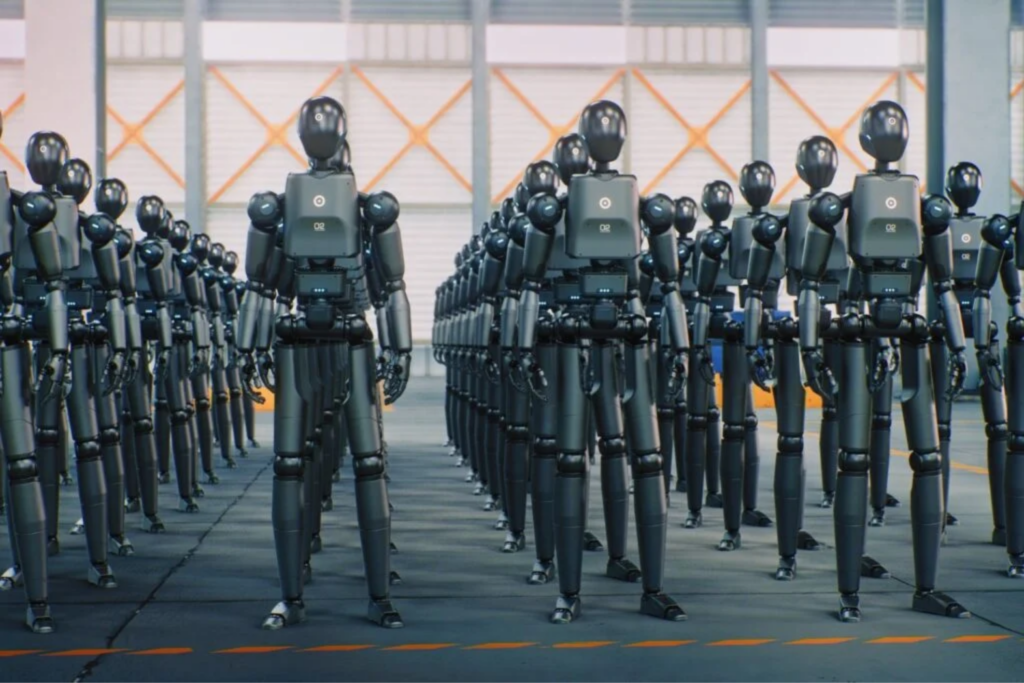

Economia, política e cultura sob pressão

No plano econômico, parte significativa do trabalho intelectual pode ser automatizada. Politicamente, cresce o risco de concentração de poder nas empresas e governos que controlam essas tecnologias. Culturalmente, surge uma crise de autenticidade: o que significa criar quando a criação pode ser replicada por máquinas?

Há também um sinal vindo de dentro da própria indústria. Profissionais ligados a grandes laboratórios de IA, como OpenAI e Anthropic, já manifestaram publicamente preocupações sobre ritmo de desenvolvimento e padrões de segurança. Quando especialistas próximos da tecnologia alertam para riscos, o debate deixa de ser teórico e passa a envolver governança global.

Um desafio institucional sem precedentes

Nossos sistemas jurídicos foram construídos sobre uma premissa implícita: apenas humanos possuem inteligência relevante. Se essa premissa não é mais válida, conceitos como responsabilidade civil, autoria intelectual, prova judicial e regulação econômica precisarão ser revistos.

O risco não está apenas em máquinas pensarem, mas em escolherem objetivos e estratégias em sistemas complexos que já escapam à compreensão total humana. Um erro, quando ocorre em escala global e automatizada, deixa de ser individual para se tornar estrutural.

Talvez o momento atual cause estranheza porque toca em um pilar profundo da identidade moderna: a exclusividade cognitiva humana. Ao longo dos séculos, a razão justificou nossa supremacia sobre o ambiente. Se essa singularidade se dissolve, as consequências são filosóficas, econômicas e políticas.

A humanidade criou algo inédito na história do planeta: uma mente artificial com capacidade de impacto real. A questão urgente não é se ela existe. É como garantir que seu desenvolvimento esteja alinhado a direitos humanos, princípios éticos e mecanismos robustos de supervisão. O desafio já começou — e ignorá-lo não o tornará menor.

[ Fonte: La Nación ]