A definição de inteligência humana nunca foi consenso — e isso cria um paradoxo: como definir Inteligência Artificial se não sabemos explicar nossa própria inteligência? Enquanto laboratórios mapeiam neurônios e empresas treinam modelos que superam pessoas em tarefas específicas, surge a pergunta central: eficiência exige inteligência real ou apenas resultados? A discussão, alimentada por pesquisadores como Melanie Mitchell e Luciano Floridi, evidencia um conflito entre o que entendemos, o que imitamos e o que substituímos.

Inteligência sem definição: o desafio que antecede a própria IA

Estudiosos de IA esbarram num ponto desconfortável: não sabemos definir inteligência com rigor científico. Sabemos que humanos raciocinam melhor que ratos, mas não sabemos explicar exatamente por quê. Em 2016, um relatório da Universidade de Stanford propôs que IA seria “um ramo da computação que estuda a inteligência por meio da inteligência sintética”. Uma definição circular, como apontou a pesquisadora Melanie Mitchell ao destacar que ainda não sabemos se estamos reproduzindo inteligência real ou apenas simulando padrões úteis.

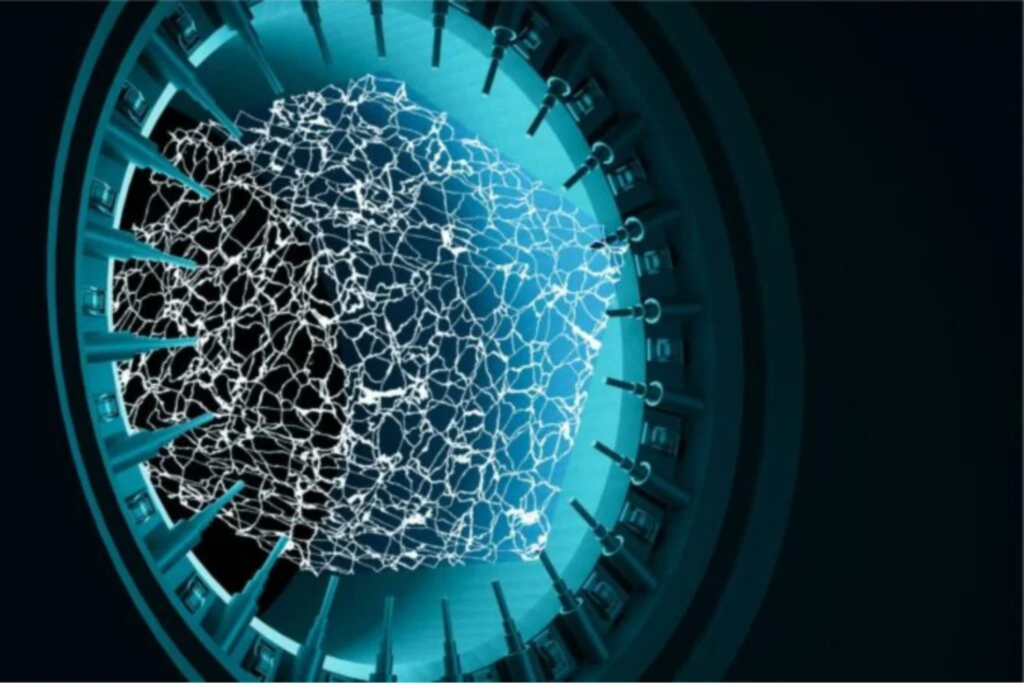

Segundo Mitchell, o campo divide-se em duas frentes. A primeira busca entender a inteligência biológica para reproduzi-la em sistemas artificiais — como o Projeto Conectoma do Google, que mapeou minuciosamente parte do cérebro humano. A segunda ignora o funcionamento biológico e se concentra em criar modelos que executam tarefas tão bem quanto nós, mesmo que não pensem como nós.

O “desacoplamento”: eficiência sem mente

Nesse cenário surge o filósofo Luciano Floridi, de Oxford, com um argumento provocador: a IA não existe para imitar o pensamento humano, mas para prescindir dele. Ela opera como se fosse inteligente — e isso basta. A metáfora da lava-louças ilustra o ponto: ela limpa pratos como um humano, mas não pensa, não planeja, não compreende. Apenas funciona.

Floridi chama essa separação entre processo e resultado de desacoplamento. A IA tem sucesso quando consegue executar uma tarefa sem depender da inteligência humana. Se ela vence um mestre de Go ou dirige um carro sem erro, é porque a tarefa foi reconhecida como desacoplável da inteligência — ou seja, pode ser resolvida sem compreensão real.

A consequência é clara: IA não substitui o pensamento humano; substitui a necessidade dele em certas tarefas.

Simular, substituir ou compreender?

O sucesso de sistemas como AlphaGo reforça essa ideia. Ele derrotou jogadores de elite não porque pensa como eles, mas porque resolve o jogo por outros meios — mais rápidos, mais amplos, mais estatísticos. O mesmo ocorre com carros autônomos: não dirigimos robôs humanoides, dirigimos algoritmos. O objetivo não é imitar o cérebro humano, mas superá-lo em funções específicas.

Críticos como Noam Chomsky e Miguel Nicolelis argumentam que a IA atual apenas simula inteligência. Modelos de linguagem, por exemplo, correlacionam dados, mas não compreendem de fato o mundo. Se não há consciência, raciocínio intencional ou compreensão semântica, pode-se chamar isso de inteligência? Ou apenas desempenho?

Simulação eficiente não é inteligência — é engenharia.

Afinal, o que é IA?

Parte do dilema nasce da falta de definição. Estudos já listaram mais de 50 definições de “inteligência” e 18 para IA. A explicação comum — “inteligência demonstrada por máquinas” — é tautológica. Floridi compara IA, amizade e amor à pornografia: talvez não possamos definir perfeitamente, mas reconhecemos quando vemos.

Assim, IA pode não ser um conceito científico fechado, como “triângulo” ou “mamífero”. Talvez seja uma família de técnicas, um conjunto flexível que agrupa sistemas com comportamentos parecidos, mesmo que não compartilhem uma essência única. Em muitos casos, basta que se pareçam inteligentes para serem tratados como tal.

[ Fonte: The Conversation Brazil ]