Por que os algoritmos de recomendação amam o caos

Segundo a professora Elaine Coimbra, vice-presidente da Associação Brasileira de Inteligência Artificial (Abria), o segredo está no objetivo desses sistemas.

A inteligência artificial não tem opinião política. Ela não “decide” nada por ideologia. O único foco dos algoritmos de recomendação é manter você preso na tela o máximo de tempo possível.

E o que prende mais a atenção? Emoções fortes.

Raiva, indignação, choque, sensação de “nós contra eles”. Quanto mais intensa a reação, mais o algoritmo entende que aquele conteúdo funciona. Resultado: você recebe mais do mesmo. E o ciclo continua.

É assim que a inteligência artificial vai estreitando o seu “mundo digital” sem você perceber.

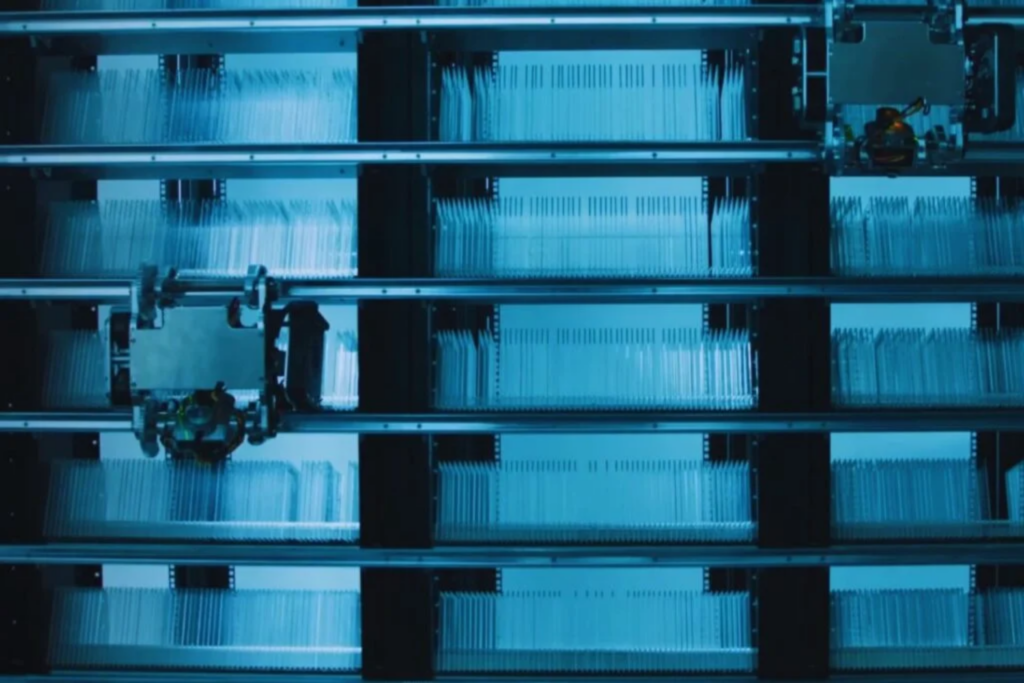

Desinformação em nível industrial

Com a chegada das IAs generativas, a desinformação atingiu outro patamar.

Hoje, textos, áudios e vídeos podem ser gerados por inteligência artificial com um realismo assustador. E o público tem dificuldade real para identificar o que é verdadeiro.

Um estudo feito com mais de mil adolescentes nos EUA revelou um dado alarmante: 41% disseram já ter visto imagens ou vídeos que pareciam reais, mas eram enganosos.

Ou seja, a desinformação não é mais um problema marginal. Ela está virando padrão.

Os algoritmos de recomendação ainda amplificam isso, porque conteúdos chocantes geram mais engajamento — e, logo, mais entrega.

Deepfakes: sinais que ainda podemos detectar

Apesar do realismo crescente, ainda existem pistas.

Segundo Elaine, conteúdos criados por inteligência artificial costumam apresentar:

– Textos com pouca variação de vocabulário

– Estruturas muito rígidas e repetitivas

– Imagens com reflexos estranhos

– Sombras incoerentes

– Iluminação impossível

– Mãos com dedos a mais

Esses são sinais clássicos de deepfakes, mas aqui vai o alerta: está ficando cada vez mais difícil detectar.

Com a evolução dos modelos, a desinformação baseada em mídia falsa tende a ficar praticamente indistinguível da realidade.

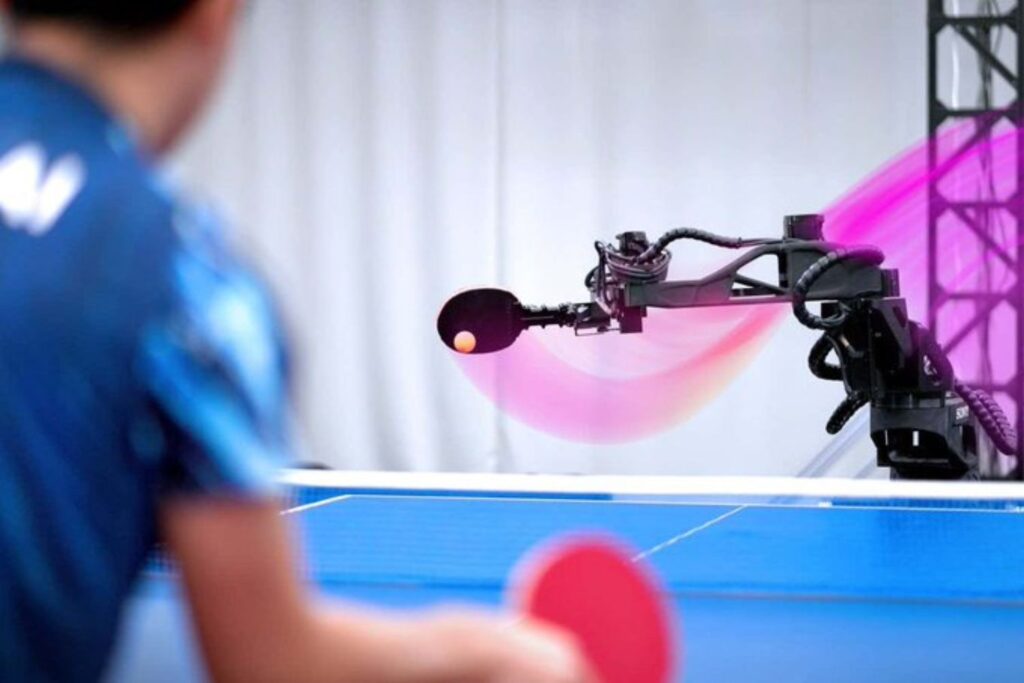

A “caixa-preta” dos algoritmos e a radicalização

Para entender como as plataformas moldam o comportamento, especialistas usam a chamada técnica de “caixa-preta”.

Funciona assim: criam perfis artificiais e observam o que os algoritmos de recomendação passam a entregar.

O padrão é preocupante: uma leve interação com conteúdo mais intenso já leva a sugestões mais radicais. É um empurrão contínuo para versões mais extremas do mesmo tema.

A inteligência artificial não “puxa” as pessoas para o radicalismo por ideologia, mas a lógica de engajamento faz isso acontecer na prática.

O debate que vem aí

Esse tema já virou prioridade internacional. Em dezembro de 2025, o evento “CB Debate Desafios 2026” vai trazer ao centro o painel “Democracia sob algoritmo: IA e a polarização em tempos de desinformação”.

O foco será justamente o impacto da inteligência artificial, dos algoritmos de recomendação e da desinformação no futuro da democracia.

O que tudo isso significa para você

A realidade digital não é mais neutra. Ela é moldada por inteligência artificial o tempo todo. Os algoritmos de recomendação não querem te informar. Querem te prender. E a desinformação circula com uma eficiência assustadora.

O verdadeiro desafio agora é aprender a navegar nesse cenário sem se perder nele. Você controla o que consome? Ou é o algoritmo que está decidindo tudo por você?

[Fonte: Correio Braziliense]