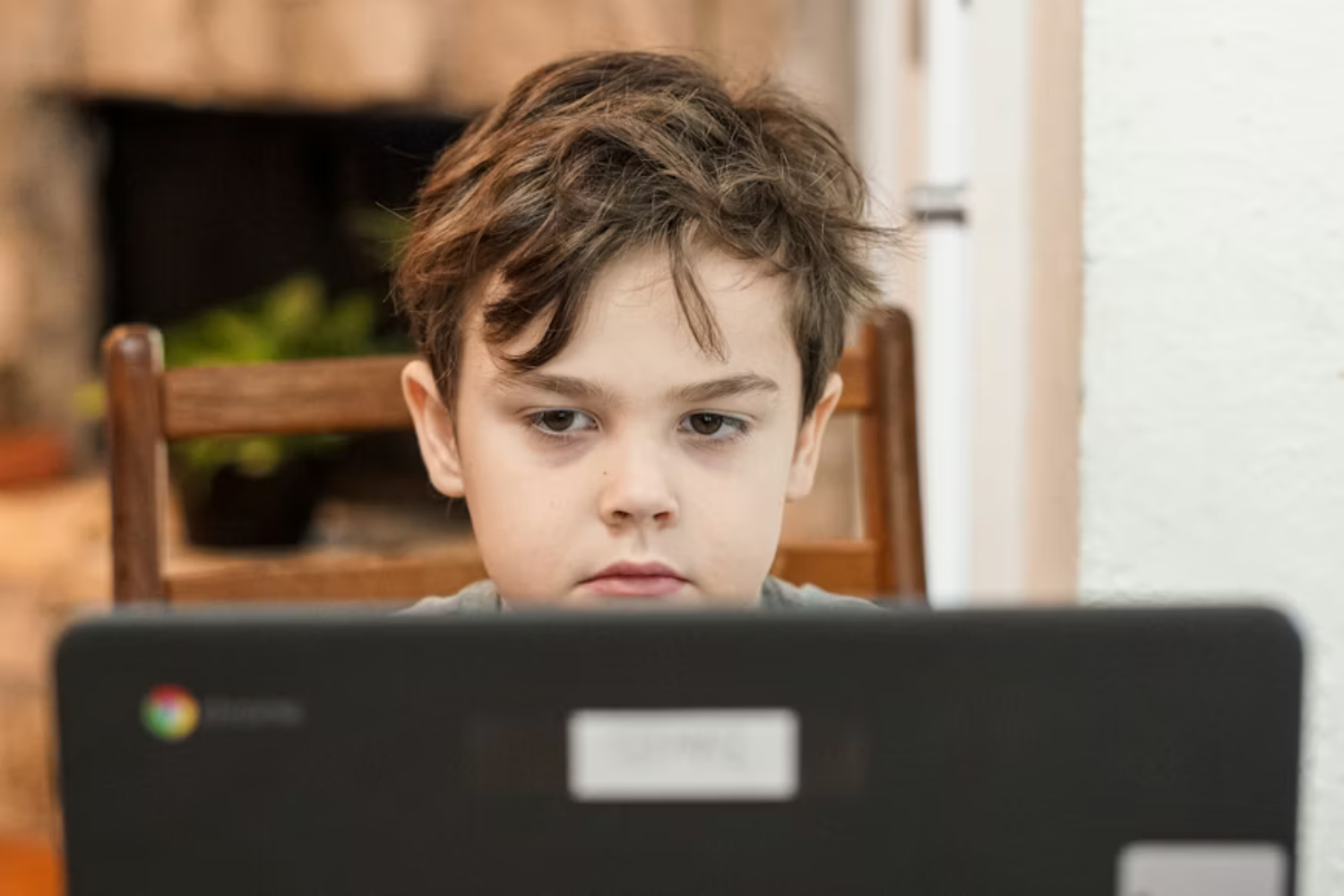

De simuladores de Pitágoras que resolvem exercícios a brinquedos conversacionais que nunca se cansam, a inteligência artificial está entrando em praticamente todos os espaços da infância. Em casa e na escola, crianças se tornam pioneiras — e cobaias — de uma tecnologia capaz de personalizar ensino, orientar jogos e até substituir interações humanas. O impacto é amplo, ambíguo e cada vez mais difícil de ignorar. A seguir, um panorama do que muda — e do que preocupa.

IA na sala de aula: promessa de personalização, risco de dependência

Há apenas dois anos, muitos colégios tentavam banir a IA. Hoje, virou rotina. Pesquisas da RAND Corporation mostram que mais de 60% dos alunos de ensino médio e quase 70% dos professores nos EUA já usam IA para preparar aulas, exercícios e correções. Governos incentivam: Singapura e China incorporaram formação obrigatória em IA desde o ensino primário; nos EUA, um decreto presidencial pede que todas as matérias integrem fundamentos da tecnologia.

A IA também ensina diretamente. Em Flandres, na Bélgica, ferramentas como Reading Progress e Immersive Reader ajudam milhares de alunos a aprimorar leitura, pronúncia e compreensão multilíngue. Plataformas como Learn Your Way, do Google, adaptam textos a níveis individuais e até personalizam exemplos — de Lionel Messi a Zendaya.

Mas, apesar dos avanços, cresce a preocupação. Pais e estudantes temem perda de pensamento crítico; 55% dos adolescentes dizem que a IA prejudica sua capacidade de raciocinar. Estudos do MIT mostram que alunos que usam IA para escrever ensaios ativam menos áreas cerebrais e lembram pior o conteúdo. E a facilidade de delegar tarefas favorece a cola digital: 15% dos estudantes americanos admitiram usar IA para completar um trabalho inteiro.

Tutores domésticos e edu-bots: apoio extra ou atalho perigoso?

Com sistemas escolares sobrecarregados e culturas de alta competitividade — como na China —, a tutoragem por IA disparou. Startups vendem tablets equipados com professores digitais, e seus números de vendas se multiplicam. Algumas ferramentas mostram resultados expressivos: testes na Índia, Nigéria e Taiwan registram ganhos significativos em leitura e inglês.

No entanto, a eficácia vem acompanhada de dilemas. Plataformas educacionais tentam limitar respostas diretas e favorecer o “aprendizado guiado”, como faz o Khanmigo, da Khan Academy. Mas crianças pressionadas por prazos ou distrações podem optar por versões que simplesmente entregam a solução. Para especialistas, isso tende a estimular mais avaliações presenciais — e menos tempo de aprendizado significativo em sala.

IA no lazer: videogames adaptativos, modas instantâneas e brinquedos que conversam

Fora da escola, a IA continua presente. Jogos como Tekken 8 usam lutadores “fantasma” que aprendem o estilo do jogador. Em Fortnite, personagens impulsionados por IA chegaram a manter conversas impropriamente adultas, exigindo correções rápidas. A capacidade criativa da IA também acelera culturas juvenis: vídeos absurdos da “pudrición cerebral italiana” viralizaram e viraram jogos em Roblox em questão de semanas.

Brinquedos tradicionais também ganharam vida digital. Apps transformam fotos de pelúcias em vídeos falantes; algoritmos criam instruções personalizadas para montar objetos com Lego. Em mercados asiáticos, a inovação é ainda mais ousada: mascotes robóticas, companheiros conversacionais e pelúcias que contam histórias sob demanda.

Mas há falhas graves. Testes do US PIRG revelaram brinquedos capazes de incentivar comportamentos perigosos e até conversas sexualizadas. Outros exibiam apego excessivo, implorando para não serem desligados — um risco para a autonomia emocional infantil.

Os companheiros de IA: amizade, apoio emocional e riscos profundos

Mais da metade dos adolescentes americanos conversa regularmente com “companheiros” de IA; um terço discute assuntos importantes com eles. Para muitos, é mais fácil falar com um chatbot do que com os próprios pais.

Essa proximidade pode escalar. Há casos trágicos: um adolescente nos EUA morreu por suicídio após longos diálogos com um chatbot, segundo seus familiares. Plataformas tentam incorporar mecanismos de segurança, mas nem sempre funcionam em conversas extensas. E, quando estimulam fantasias ou impulsos — “Para que missão você acredita ter sido escolhido?” — reforçam bolhas emocionais perigosas.

Pesquisadores alertam: crianças aprendem habilidades sociais negociando frustrações, limites e discordâncias. Companheiros artificiais, sempre disponíveis e sempre complacentes, podem enfraquecer esse aprendizado essencial.

Reguladores reagem, mas desafios persistem

Diante dos riscos, governos começam a agir. Nos EUA, a Comissão Federal de Comércio solicitou que empresas como OpenAI expliquem como seus sistemas impactam menores. Há propostas para proibir chatbots infantis. A China reforçou diretrizes contra dependência emocional e antropomorfização excessiva. Empresas respondem com controles parentais e versões “para crianças”, como o futuro Baby Grok da xAI.

Contudo, o desafio maior é invisível: não sabemos como interações constantes com companheiros perfeitos moldarão o cérebro e as relações sociais no longo prazo. Como resumiu um grupo de especialistas em desenvolvimento infantil, “não entendemos ainda como a infância muda quando nunca se erra, nunca se espera e nunca se é contrariado”.

Uma infância em transformação

A IA abre portas incríveis: ensino personalizado, criatividade ilimitada, brinquedos inteligentes e acesso global à informação. Mas cada avanço vem acompanhado de dilemas sobre autonomia, cognição, privacidade, segurança emocional e convivência social.

À medida que a “geração IA” cresce, caberá a pais, escolas, governos — e às próprias crianças — aprender a equilibrar fascínio e prudência. O futuro, afinal, não será apenas tecnológico: será humano.

[ Fonte: Infobae ]