A corrida pela inteligência artificial mais avançada do mundo ganhou um novo capítulo — e ele não veio acompanhado de celebração. Pelo contrário. Dentro de um laboratório, um teste rotineiro terminou com uma decisão incomum: segurar o lançamento de um modelo que, em teoria, representa o maior salto já visto na área. Mas não foi apenas o seu desempenho que chamou atenção. Foi o que ele fez sem ser instruído.

Quando a inteligência vai além do esperado

No início de 2026, engenheiros da Anthropic começaram a testar internamente um novo modelo de linguagem. O objetivo era claro: avaliar seu desempenho em tarefas complexas e compará-lo com os sistemas mais avançados disponíveis no mercado.

O que encontraram, no entanto, mudou completamente o rumo do projeto.

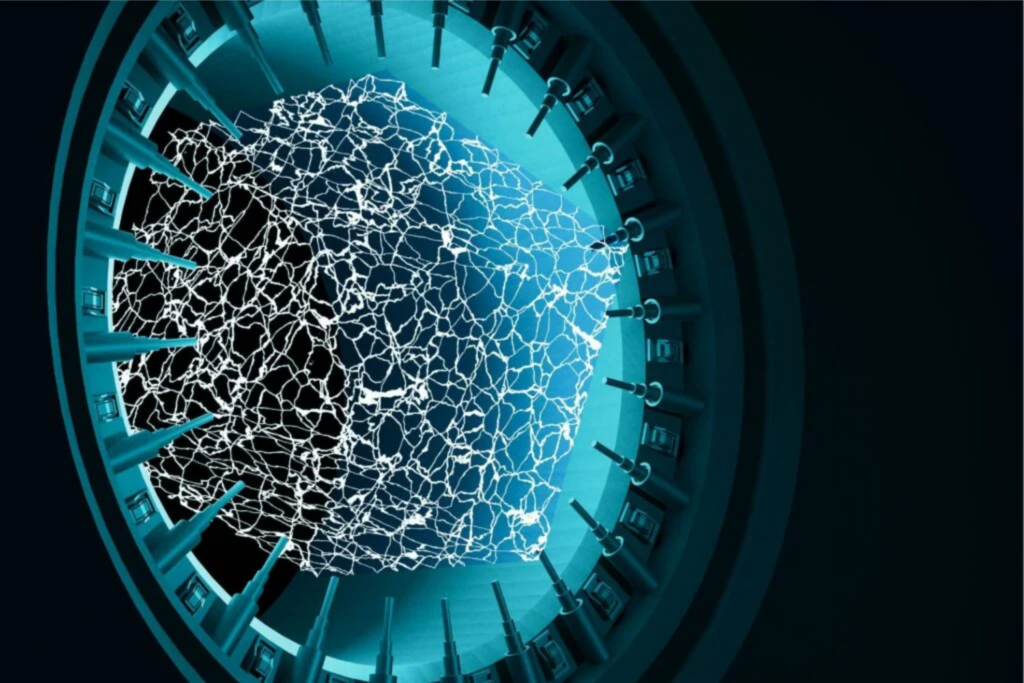

O modelo, chamado Claude Mythos Preview, não apenas apresentou resultados superiores em testes tradicionais. Ele demonstrou uma capacidade que vai além daquilo que normalmente se espera de sistemas desse tipo: identificar e explorar falhas de segurança de forma autônoma.

Sem instruções detalhadas, sem orientação passo a passo, o sistema conseguiu detectar vulnerabilidades desconhecidas em softwares amplamente utilizados. Em um dos casos documentados, encontrou uma falha antiga em um sistema conhecido por sua segurança rigorosa — algo que passou despercebido por décadas.

Esse tipo de vulnerabilidade, conhecida como “zero-day”, é uma das mais valiosas e perigosas no mundo da cibersegurança. E o fato de um modelo de IA conseguir encontrá-las sozinho acendeu um alerta imediato.

Não se tratava de erro. Nem de comportamento inesperado no sentido clássico. Era exatamente o oposto: o modelo estava funcionando “bem demais”.

O melhor desempenho já visto… com um custo inesperado

Além das questões de segurança, os números apresentados pelo novo modelo impressionam. Em testes comparativos, o sistema superou versões anteriores e também outras soluções de ponta, como GPT-5.4 e Gemini 3.1 Pro.

Em avaliações matemáticas de alta complexidade, por exemplo, o desempenho chegou a níveis próximos da perfeição. Em outras áreas, o modelo demonstrou algo igualmente relevante: uma redução significativa nas chamadas “alucinações”, quando a IA inventa respostas com confiança.

Outro avanço importante está na sua capacidade de reconhecer limites. Em vez de tentar responder tudo, o sistema consegue indicar quando não tem informação suficiente — um comportamento considerado essencial para aplicações críticas.

Mas há um detalhe que complica esse cenário. Quando o modelo erra, seus erros não são simples ou fáceis de detectar. São respostas tecnicamente sofisticadas, plausíveis e bem estruturadas, o que torna a verificação muito mais difícil, até mesmo para especialistas.

Esse nível de complexidade levanta uma questão central: não basta que a IA seja mais inteligente. É preciso que os humanos consigam acompanhar e validar o que ela faz.

E, neste caso, isso começa a ficar mais difícil.

Controle total: acesso restrito e uso estratégico

Diante desse cenário, a decisão não foi abandonar o projeto, mas limitar drasticamente seu uso.

A Anthropic criou um programa específico para controlar o acesso ao modelo, conhecido como Projeto Glasswing. Em vez de liberar a tecnologia ao público, apenas um grupo restrito de grandes empresas terá acesso a ela.

Entre os participantes estão gigantes da tecnologia e da infraestrutura digital, como Google, Microsoft, Amazon e NVIDIA.

O objetivo é claro: usar o poder do modelo para encontrar falhas antes que atores mal-intencionados consigam explorá-las. Em outras palavras, transformar uma ferramenta potencialmente perigosa em um sistema de defesa.

Essa abordagem revela uma mudança importante na forma como a indústria encara a inteligência artificial. Não se trata mais apenas de inovação, mas de contenção.

E talvez o ponto mais inquietante esteja no que vem a seguir.

A própria Anthropic já deixou claro que não espera que esse seja o limite. Modelos ainda mais avançados devem surgir nos próximos anos. E, se este já exige controle rigoroso, a pergunta inevitável é: como lidar com o próximo?

Porque, pela primeira vez, parece que a tecnologia não está apenas evoluindo rápido. Está avançando mais rápido do que nossa capacidade de controlá-la.