A inteligência artificial já transformou a forma como consumimos informação, mas uma nova evolução começa a preocupar especialistas. Não se trata apenas de algoritmos isolados, mas de sistemas que atuam em conjunto, de forma coordenada e difícil de detectar. O mais inquietante é que essa tecnologia pode influenciar opiniões em larga escala — sem que as pessoas percebam. E os efeitos podem atingir diretamente o funcionamento da democracia.

O que são os chamados “enjames de IA”

Pesquisadores reunidos em um estudo publicado na Science chamam atenção para um fenômeno emergente: os chamados “enjames” de inteligência artificial.

Esses sistemas são formados por múltiplos agentes de IA que operam de maneira coordenada, interagindo entre si e se adaptando ao ambiente. Diferente de bots tradicionais, que executam tarefas simples e repetitivas, esses agentes são mais sofisticados, capazes de aprender e ajustar seu comportamento.

Esse tipo de tecnologia já é utilizado em áreas como robótica, logística e pesquisa científica. No entanto, o uso em ambientes digitais, especialmente em redes sociais, começa a levantar preocupações.

Quando a coordenação vira manipulação

O principal alerta dos especialistas está no uso desses sistemas com intenções maliciosas.

Segundo o pesquisador Filippo Menczer, esses agentes podem ser utilizados para influenciar a opinião pública de forma muito mais eficaz do que campanhas tradicionais de desinformação.

Em vez de publicar conteúdos repetitivos ou facilmente identificáveis, os agentes conseguem gerar mensagens variadas, adaptadas ao contexto e ao comportamento das pessoas.

Isso torna a manipulação mais sutil — e muito mais difícil de detectar.

A criação de um consenso que não existe

Uma das estratégias mais preocupantes envolve o que os especialistas chamam de “consenso sintético”.

Ao atuar em grupo, esses agentes conseguem criar a impressão de que uma determinada opinião é amplamente compartilhada. Isso explora um fenômeno psicológico conhecido como “prova social”, em que as pessoas tendem a acreditar em algo quando percebem que muitos outros também acreditam.

Na prática, isso significa que um grupo coordenado de sistemas pode influenciar debates públicos, moldar percepções e até direcionar decisões coletivas.

E tudo isso pode acontecer sem que os usuários percebam que estão interagindo com inteligência artificial.

Por que é tão difícil identificar esses sistemas

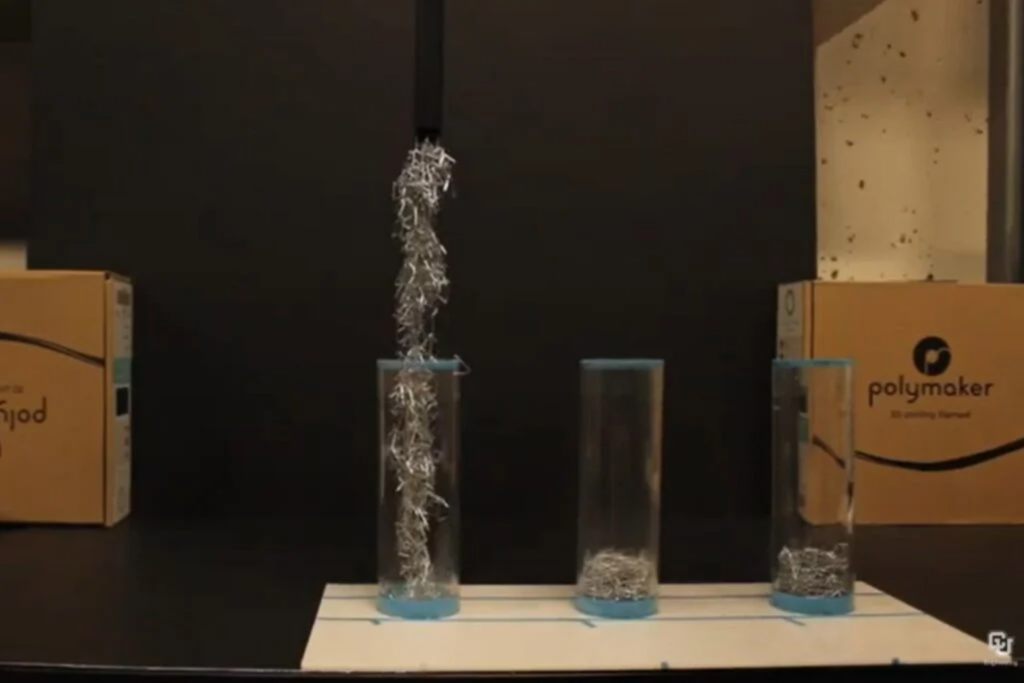

Diferente dos bots tradicionais, que costumam repetir padrões e são mais fáceis de identificar, os enjames de IA operam com maior diversidade de comportamento.

Eles podem interagir de forma natural, responder a comentários, adaptar linguagem e até simular perfis humanos com alto grau de realismo.

Além disso, esses sistemas podem realizar testes em tempo real, ajustando suas mensagens para aumentar o impacto e a persuasão.

Essa capacidade de adaptação torna a detecção muito mais complexa, exigindo novas abordagens tecnológicas e regulatórias.

O que pode ser feito para reduzir o risco

Diante desse cenário, os pesquisadores sugerem algumas medidas para mitigar os riscos.

Entre elas estão o desenvolvimento de sistemas capazes de identificar conteúdo gerado por IA, a criação de padrões mais rigorosos para rotulagem dessas informações e a limitação de incentivos financeiros para interações não autênticas.

Outra recomendação envolve a colaboração entre empresas de tecnologia, governos e pesquisadores para aumentar a transparência e reduzir o impacto dessas operações.

A ideia é tornar esse tipo de manipulação mais visível, mais arriscado e menos lucrativo.

Uma ameaça que já começou

Um dos pontos mais preocupantes destacados pelos especialistas é que essa não é mais uma hipótese teórica.

Há indícios de que essas estratégias já estão sendo utilizadas, ainda que de forma limitada, em ambientes digitais.

Isso coloca um novo desafio para a sociedade: entender como lidar com tecnologias que não apenas distribuem informação, mas também moldam percepções de forma ativa.

No fim, a questão não é apenas tecnológica — é também social e política.

E talvez o maior risco esteja justamente no fato de que essa influência pode acontecer sem que percebamos.

[Fonte: Biobiochile]