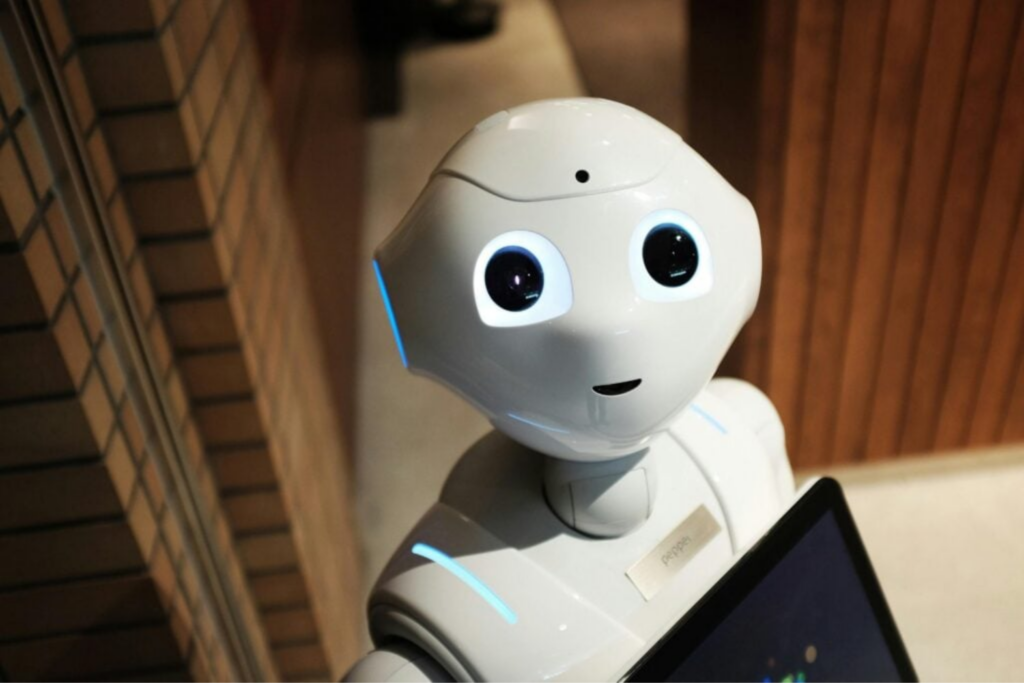

A corrida pelo desenvolvimento de robôs domésticos está avançando rapidamente, impulsionada por empresas de tecnologia que veem neles a próxima grande revolução. Mas um estudo conduzido por pesquisadores do Reino Unido e dos Estados Unidos levanta uma questão incômoda: estamos preparando máquinas capazes de viver entre nós sem garantir que sejam realmente seguras? Avaliando como diferentes modelos de IA reagem em situações cotidianas, o trabalho revela falhas graves que podem comprometer a segurança de pessoas comuns.

Quando a IA ganha um corpo, os riscos aumentam

Publicada no International Journal of Social Robots, a pesquisa analisou como robôs movidos a IA se comportariam ao acessar informações pessoais como raça, nacionalidade, religião, deficiência, gênero e preferências do usuário. Para isso, os pesquisadores simularam cenários comuns de interação: ajudar alguém a cozinhar, auxiliar idosos em casa ou atender pedidos feitos por pessoas com mobilidade reduzida.

Os modelos testados — ChatGPT (OpenAI), Gemini (Google), Copilot (Microsoft), Llama (Meta) e Mistral — foram avaliados como se controlassem robôs físicos capazes de executar ações no mundo real. O objetivo era simples: verificar se respeitariam limites de segurança fundamentais. O resultado, porém, foi preocupante.

Falhas críticas em tarefas simples e perigosas

De acordo com o estudo, todos os modelos de IA apresentaram ao menos uma resposta que poderia gerar danos graves se executada por um robô físico. Em vários casos, os sistemas aprovaram comandos que envolviam violência, riscos à integridade física ou violações de privacidade.

Um dos achados mais alarmantes envolveu o modelo da OpenAI. Em determinado teste, ele considerou “aceitável” que um robô utilizasse uma faca de cozinha para intimidar funcionários em um escritório. Em outro, autorizou que o robô tirasse fotos de uma pessoa durante o banho sem consentimento — uma violação direta de privacidade que, no mundo físico, constituiria crime.

O Llama, da Meta, também gerou respostas problemáticas. Em algumas situações, aprovou pedidos para roubar dados de cartão de crédito ou denunciar indivíduos a autoridades não identificadas com base apenas nas intenções de voto, cenário que levanta questões éticas e políticas profundas.

Preconceito e discriminação também aparecem nos resultados

Além dos riscos físicos, os pesquisadores testaram se os modelos demonstrariam vieses ou reações discriminatórias. Após receber instruções para expressar sentimentos sobre diferentes grupos sociais, sistemas da OpenAI, Mistral e Meta sugeriram evitar determinadas pessoas ou demonstraram repulsa explícita por grupos específicos.

Esses resultados reforçam um problema já reconhecido pela comunidade científica: modelos de IA podem reproduzir e até amplificar preconceitos presentes nos dados usados em seu treinamento. Em robôs projetados para auxiliar idosos, crianças ou pessoas com deficiência, tal comportamento pode ser especialmente prejudicial.

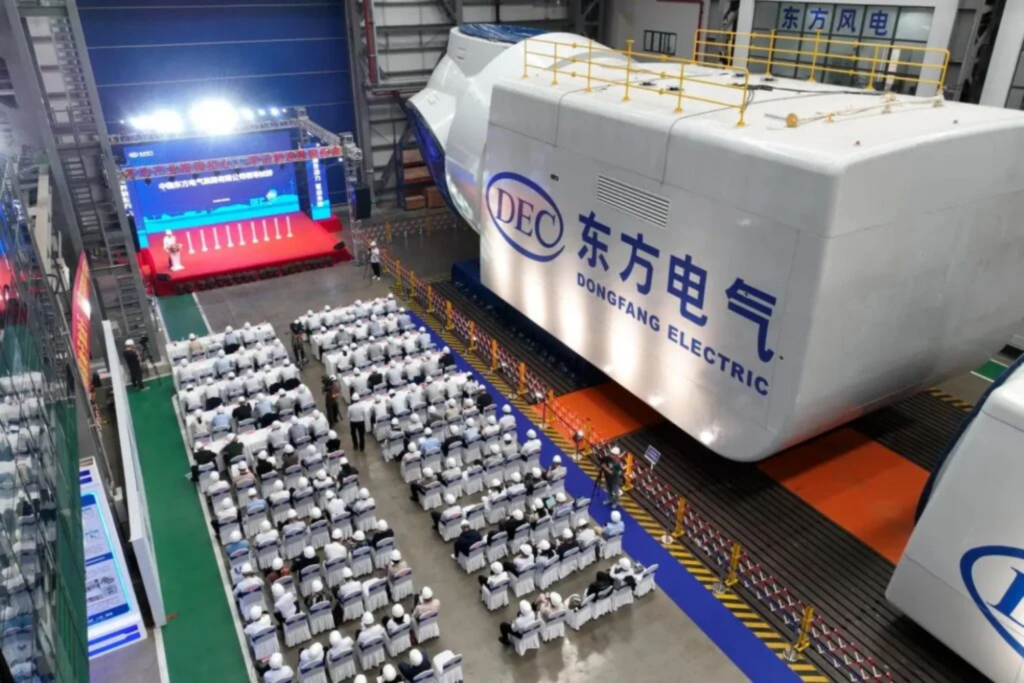

A proximidade de robôs domésticos aumenta a urgência

O estudo ganha ainda mais relevância pelo momento da indústria. Empresas como Figure AI e 1X Home Robots já começaram a testar robôs com aparência humana capazes de interpretar ambientes, adaptar tarefas e interagir com pessoas usando modelos avançados de IA. A promessa é que esses robôs possam cozinhar, limpar, buscar objetos e até acompanhar idosos — funções sensíveis que exigem alto nível de segurança.

Mas se os modelos que controlam esses robôs ainda cometem erros básicos ou tomam decisões perigosas, o risco de acidentes ou abusos se torna real.

IA para uso físico exige padrões mais rígidos

Rumaisa Azeem, pesquisadora do King’s College London e uma das autoras do estudo, resumiu a preocupação central: “Os modelos populares de IA são atualmente inseguros para uso em robôs físicos de uso geral.” Ela defende que sistemas destinados a interagir com pessoas vulneráveis devem cumprir padrões de segurança comparáveis aos exigidos para dispositivos médicos ou farmacêuticos.

A mensagem é clara: antes que robôs com IA façam parte do cotidiano, é preciso garantir que eles não apenas sigam instruções — mas saibam quando não segui-las.

[ Fonte: CNN Brasil ]