Em um cenário onde aplicativos de relacionamento já moldam a forma como as pessoas se conectam, uma ideia curiosa começou a circular nas redes sociais: usar inteligência artificial para evitar repetir erros amorosos. A proposta parece simples — mas também inquietante. Afinal, até que ponto faz sentido delegar decisões emocionais a um algoritmo?

A história que viralizou nas redes

Tudo começou com um relato publicado na rede social X. Nele, um homem chamado Marcos, de 31 anos, teria decidido usar inteligência artificial para evitar cair em relacionamentos semelhantes ao anterior.

Após um término difícil, ele teria reunido milhares de mensagens trocadas com sua ex-parceira — cerca de 38 mil conversas do WhatsApp — para treinar um modelo capaz de identificar padrões de comportamento considerados problemáticos.

A lógica era direta: se ele havia escolhido mal antes, talvez precisasse de uma “segunda opinião” — e não de amigos ou familiares, mas de um sistema automatizado.

Como funcionaria o suposto “filtro emocional”

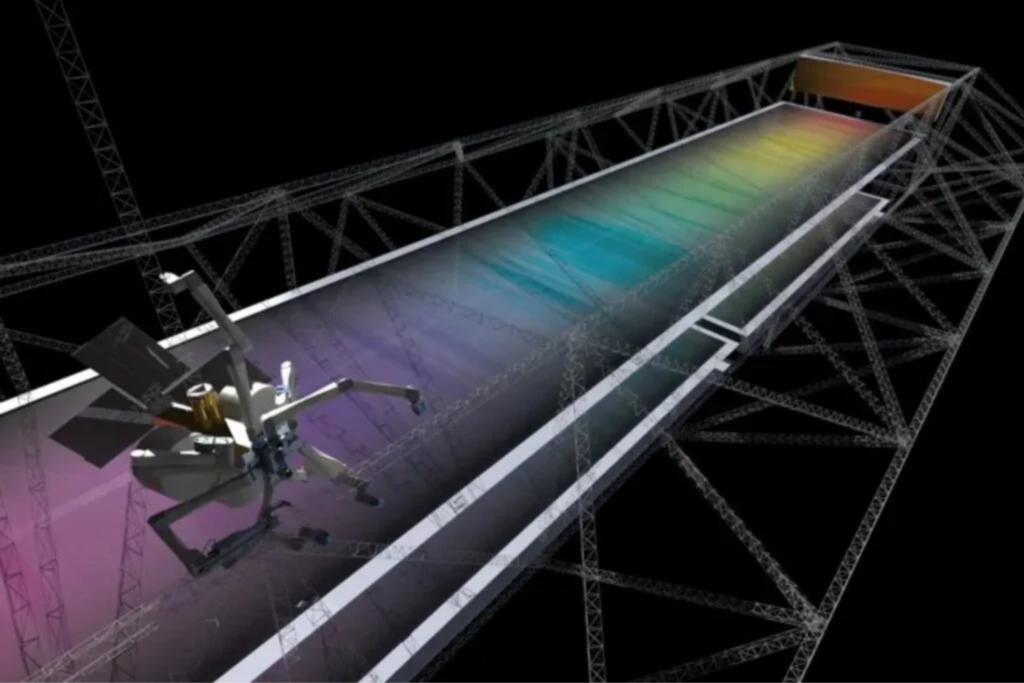

Segundo o relato, o sistema, apelidado de ExFilter, analisaria novas conversas em aplicativos de namoro como o Tinder.

A ferramenta buscaria sinais associados a relações tóxicas, como:

– demonstrações intensas de afeto muito cedo (o chamado love bombing)

– tendência a culpar todos os ex-parceiros

– uso frequente de terceiros para provocar ciúmes

– comportamentos inconsistentes em planos e compromissos

– possíveis contradições em questões financeiras

Com base nesses padrões, o sistema atribuiria uma pontuação de “semelhança” com a ex do usuário.

Se o resultado fosse alto, o contato seria interrompido. Caso contrário, a conversa poderia continuar.

A promessa de evitar erros — e suas implicações

No relato, Marcos teria usado o sistema por alguns meses, descartando diversas possíveis parceiras antes de iniciar um novo relacionamento.

A ideia chamou atenção por tocar em questões comuns: o medo de repetir padrões, o desgaste com aplicativos de namoro e a busca por mais controle nas relações.

Mas também levanta um ponto delicado: até que ponto é saudável transformar experiências pessoais em dados e utilizá-los como critério para decisões afetivas?

Entre fascínio e desconfiança

Apesar da popularidade da história, não há confirmação sólida de que o projeto realmente exista.

O suposto código teria sido publicado no GitHub, mas usuários não encontraram evidências consistentes de sua disponibilidade.

Além disso, não há comprovação de que modelos de IA como o Claude tenham sido utilizados dessa forma.

Essas lacunas levantam dúvidas sobre a veracidade do caso, sugerindo que pode se tratar de uma narrativa exagerada — ou até fictícia.

O que essa ideia revela sobre o presente

Independentemente de ser real ou não, o conceito por trás do ExFilter revela algo importante sobre o momento atual.

A inteligência artificial já não está restrita a tarefas técnicas ou profissionais. Ela começa a entrar em áreas mais subjetivas, como emoções, relacionamentos e decisões pessoais.

Isso abre novas possibilidades — mas também novos dilemas.

Quando algoritmos entram na vida emocional

Delegar decisões afetivas a um sistema automatizado pode parecer uma forma de evitar erros, mas também pode limitar experiências humanas fundamentais, como intuição, aprendizado e mudança.

Relacionamentos são dinâmicos, imprevisíveis e muitas vezes fogem de padrões rígidos.

Transformá-los em dados pode simplificar demais algo que, por natureza, é complexo.

Uma tendência que pode ir além da curiosidade

Mesmo que o ExFilter não exista, a ideia não está tão distante da realidade.

Ferramentas baseadas em IA já são usadas para sugerir matches, analisar perfis e até ajudar na comunicação dentro de aplicativos de relacionamento.

A diferença é que, nesse caso, o algoritmo não apenas sugere — ele decide quem merece ou não uma chance.

No fim, tecnologia ou escolha humana?

A história viral pode ser vista como exagero, alerta ou previsão.

Ela mostra até onde a tecnologia pode chegar — e até onde as pessoas estão dispostas a deixar que ela vá.

No fim, a pergunta não é apenas se a IA pode ajudar nas relações, mas se deve.

[Fonte: As]