A inteligência artificial costuma ser associada à objetividade: estatísticas, padrões matemáticos, previsões. Mas algoritmos não surgem no vácuo. Eles são treinados com dados produzidos por pessoas, em sociedades marcadas por desigualdades históricas. Isso inclui desigualdades de gênero.

A pergunta, portanto, não é se a IA “tem” gênero no sentido biológico. A questão é se ela reproduz estruturas sociais que privilegiam um padrão masculino como universal — e as evidências sugerem que sim.

A desigualdade começa antes da programação

Em diversos países europeus, mulheres são maioria no ensino superior. Ainda assim, sua presença cai drasticamente nas áreas mais tecnológicas. Na Espanha, por exemplo, elas representam 57% dos estudantes de graduação e mestrado, mas apenas 28,1% em Engenharia e Arquitetura e 17,2% em Informática.

Esse fenômeno é conhecido como “pipeline vazado” — a perda progressiva de mulheres ao longo da carreira científica e tecnológica. Menos diversidade na formação significa menos diversidade nas equipes que desenvolvem sistemas de IA.

E isso impacta decisões técnicas, prioridades de pesquisa e critérios de validação.

O padrão masculino como “universal”

O viés de gênero na ciência não é novidade. Na biomedicina, análises de centenas de ensaios clínicos mostram que cerca de dois terços não apresentam resultados diferenciados por sexo nem justificam essa ausência.

Um caso emblemático foi o do zolpidem, comercializado como Ambien. Durante anos, a dosagem recomendada foi a mesma para homens e mulheres. Só em 2013 descobriu-se que mulheres apresentavam maior risco de efeitos adversos — e a dose passou a ser reduzida pela metade para elas.

No livro Invisible Women (2019), a jornalista britânica Caroline Criado-Perez descreve esse padrão como uma falha sistêmica: o homem é tratado como norma; a mulher, como exceção estatística.

Quando essa lógica alimenta bancos de dados e modelos matemáticos, o problema se automatiza.

A IA amplifica o que aprende

Pesquisadoras como Safiya Umoja Noble demonstraram que mecanismos de busca aparentemente neutros podem reproduzir resultados racistas e sexistas. Já Timnit Gebru e Joy Buolamwini evidenciaram falhas graves em sistemas de reconhecimento facial, especialmente em mulheres negras.

A cientista de dados Cathy O’Neil chama certos modelos de “armas de destruição matemática”, pois transformam preconceitos sociais em decisões automatizadas que afetam crédito, emprego e segurança.

No caso dos grandes modelos de linguagem, como o GPT-3, estudos mostraram associações problemáticas: determinados grupos religiosos ou étnicos apareciam ligados a termos como violência ou terrorismo com frequência desproporcional.

A máquina não “inventa” o preconceito. Ela aprende padrões estatísticos presentes no corpus — grandes conjuntos de textos extraídos da internet. Se o mundo retratado nesses dados é desigual, o modelo refletirá essa desigualdade.

Quando o idioma também influencia

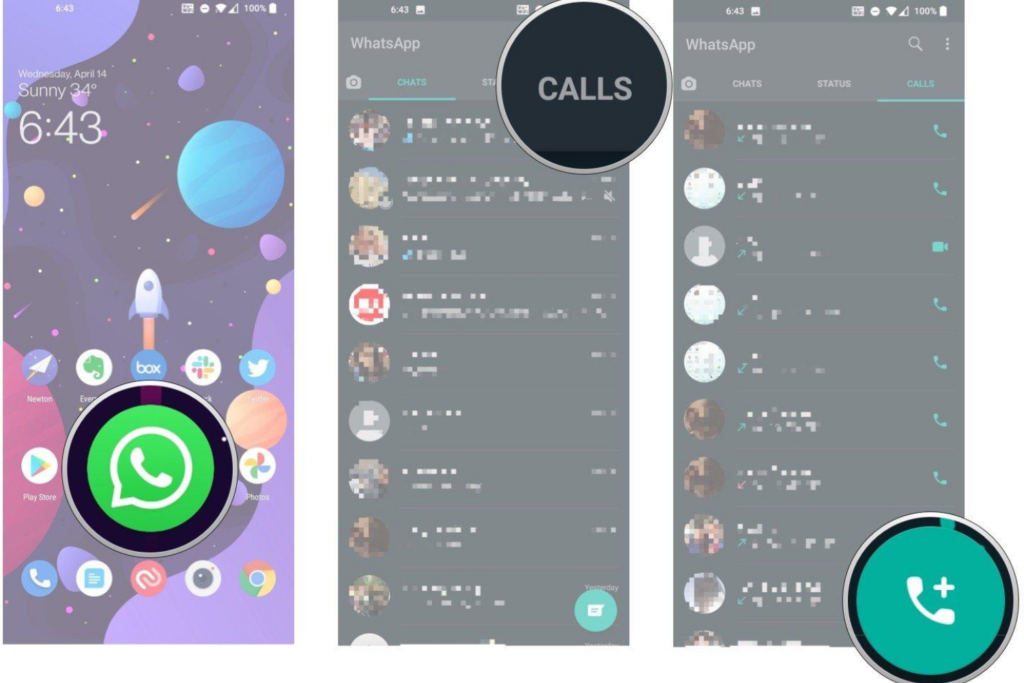

O viés não está apenas nas palavras explícitas, mas nas inferências implícitas. Sistemas de tradução automática, por exemplo, ao converter frases de idiomas neutros para línguas com marcação de gênero, podem escolher “engenheiro” como masculino e “enfermeira” como feminino, baseando-se em estereótipos.

O mesmo vale para assistentes virtuais. A escolha recorrente de vozes femininas para funções de atendimento reforça a associação simbólica entre mulher e cuidado, enquanto papéis técnicos ou de autoridade tendem a ser representados por vozes masculinas.

A IA não tem sexo biológico. Mas ela recebe uma personalidade moldada por expectativas culturais — muitas vezes de forma estratégica, para aumentar aceitação comercial.

Diversidade como critério científico

A solução não está apenas em adicionar mais dados. É necessário diversificar quem desenvolve, testa e valida os sistemas.

Equipes mais plurais identificam falhas que grupos homogêneos podem ignorar. Além disso, é fundamental auditar bases de dados, prompts e resultados com testes específicos de gênero, revisar configurações padrão e ampliar a consciência linguística.

Porque, no fim das contas, a IA não tem gênero — mas opera em um mundo que tem. E se não questionarmos as estruturas que alimentam os algoritmos, eles continuarão a reproduzir desigualdades com a eficiência de uma equação matemática.

[ Fonte: The Conversation ]