Durante anos, conversar com inteligências artificiais por voz parecia algo limitado a comandos simples e respostas mecânicas. Mas a OpenAI quer mudar esse cenário rapidamente. A empresa responsável pelo ChatGPT anunciou uma nova geração de modelos de áudio capazes de compreender diálogos complexos, lidar com interrupções e até traduzir conversas ao vivo. O lançamento reforça a corrida para criar assistentes cada vez mais próximos de uma interação humana real — e talvez seja apenas o começo de algo ainda maior.

A OpenAI quer transformar voz em uma nova interface da inteligência artificial

A OpenAI anunciou nesta quinta-feira uma nova série de modelos voltados para tarefas de voz em tempo real dentro de sua plataforma para desenvolvedores.

O objetivo é claro: levar a inteligência artificial além de chats tradicionais e sistemas de transcrição, aproximando-a de agentes capazes de conversar, interpretar contexto e executar ações instantaneamente durante diálogos ao vivo.

Ao todo, foram apresentados três modelos principais:

- GPT-Realtime-2

- GPT-Realtime-Translate

- GPT-Realtime-Whisper

Todos já estão disponíveis para testes no playground da empresa destinado a desenvolvedores.

Segundo a OpenAI, os novos sistemas foram criados para tornar interações por voz mais naturais, fluidas e úteis em situações do cotidiano.

O GPT-Realtime-2 é o modelo mais avançado do grupo. Ele foi projetado para lidar com conversas mais longas e complexas, mantendo contexto durante diálogos extensos, respondendo a interrupções e até acionando ferramentas externas enquanto a conversa acontece.

Na prática, isso significa que futuros assistentes de voz poderão funcionar de maneira muito mais dinâmica, sem depender daquele modelo engessado de perguntas e respostas isoladas.

A proposta aproxima esses sistemas da ideia de agentes inteligentes capazes de acompanhar conversas em tempo real quase como um atendente humano.

Traduções ao vivo e transcrição instantânea entram na disputa pela próxima geração da IA

Outro destaque do anúncio foi o GPT-Realtime-Translate, modelo focado em tradução simultânea.

Segundo a OpenAI, ele consegue interpretar mais de 70 idiomas e gerar respostas em 13 idiomas diferentes em tempo real. A empresa acredita que a ferramenta poderá ser utilizada principalmente em áreas como atendimento ao cliente, educação, reuniões internacionais e suporte multilíngue.

A ideia é permitir que pessoas conversem naturalmente enquanto a IA traduz a fala quase instantaneamente.

Já o GPT-Realtime-Whisper aposta numa tarefa diferente, mas igualmente estratégica: transformar fala em texto ao vivo.

O sistema foi desenvolvido para criar legendas automáticas, gerar notas de reuniões e atualizar fluxos de trabalho enquanto alguém ainda está falando. Isso abre espaço para aplicações em videoconferências, produtividade corporativa, criação de conteúdo e acessibilidade.

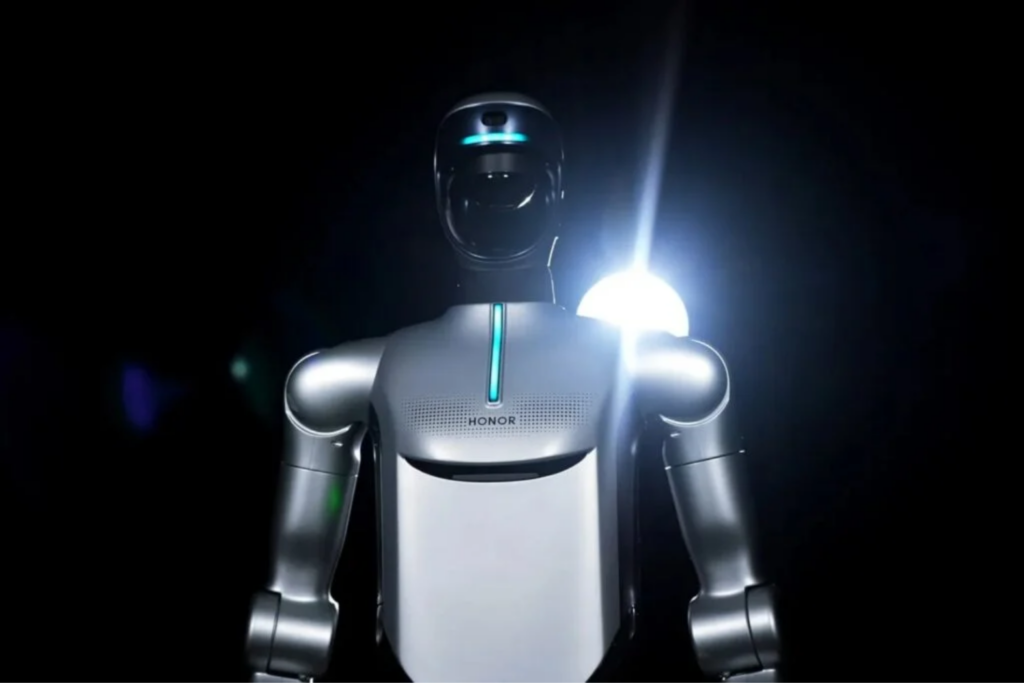

A OpenAI tenta, com esses lançamentos, consolidar sua presença numa área que vem se tornando cada vez mais disputada: interfaces de voz alimentadas por inteligência artificial.

Gigantes da tecnologia vêm apostando pesado nesse setor justamente porque a voz é vista como uma das possíveis portas de entrada para a próxima geração da computação cotidiana.

Grandes empresas já começaram a testar os novos modelos

Entre as companhias que estão experimentando as novas ferramentas estão nomes conhecidos do mercado internacional.

A plataforma imobiliária Zillow, a agência de viagens Priceline e a empresa de telecomunicações Deutsche Telekom aparecem entre os primeiros clientes envolvidos nos testes.

Os preços divulgados pela OpenAI mostram que a empresa pretende posicionar os modelos tanto para aplicações empresariais quanto para projetos em escala maior.

O GPT-Realtime-2 custará a partir de US$ 32 por milhão de tokens de entrada de áudio. Já o GPT-Realtime-Translate terá preço de US$ 0,034 por minuto, enquanto o GPT-Realtime-Whisper custará US$ 0,017 por minuto.

Embora os valores pareçam técnicos para usuários comuns, eles revelam algo importante: a OpenAI está acelerando a construção de um ecossistema comercial completo em torno da IA por voz.

Os rumores sobre um “GPT-Fone” ganharam ainda mais força

O anúncio dos novos modelos coincidiu com outro rumor que vem crescendo nos bastidores da indústria de tecnologia.

Segundo o analista Ming-Chi Kuo, conhecido por antecipar informações sobre cadeias de produção, a OpenAI pode estar trabalhando em seu primeiro produto de hardware próprio: um smartphone centrado em inteligência artificial.

O projeto ainda não foi confirmado oficialmente, mas os rumores indicam que a empresa estaria acelerando o desenvolvimento, com possível produção em massa prevista para o início de 2027.

A combinação entre novos sistemas de voz em tempo real e especulações sobre um dispositivo próprio acabou alimentando ainda mais as discussões sobre o futuro da OpenAI.

Porque, se a empresa realmente pretende criar uma plataforma baseada em conversas naturais e assistentes inteligentes permanentes, controlar também o hardware poderia ser um passo estratégico enorme.

E talvez seja justamente isso que esteja começando a acontecer agora.

[Fonte: Olhar digital]