As previsões sobre o futuro da inteligência artificial sempre oscilaram entre entusiasmo e cautela. Mas, desta vez, o alerta vem de dentro de um dos centros mais influentes do setor. A possibilidade de alcançar um novo nível de capacidade em poucos anos muda o ritmo da discussão. Ainda assim, o ponto mais provocador não está no prazo — e sim naquilo que, até agora, as máquinas ainda não conseguem fazer.

Um horizonte mais próximo do que parecia possível

A ideia de uma inteligência artificial capaz de operar de forma comparável à humana — conhecida como AGI — deixou de ser um conceito distante para entrar em um cenário mais imediato. Segundo projeções recentes, esse avanço pode acontecer em um intervalo de poucos anos, e não mais em décadas como se pensava anteriormente.

Esse tipo de sistema não representaria apenas uma evolução das tecnologias atuais. Seria uma mudança de natureza: sair de ferramentas altamente especializadas para modelos capazes de raciocinar, planejar e se adaptar a situações novas de forma flexível.

O que impulsiona essa expectativa não é um único avanço isolado, mas a combinação de vários fatores. Nos últimos anos, houve um crescimento acelerado na capacidade computacional, na qualidade dos modelos e nas técnicas de aprendizado. O ritmo dessa evolução surpreendeu até especialistas da área, encurtando prazos que antes pareciam mais conservadores.

Ainda assim, essa proximidade levanta uma questão inevitável: estamos realmente falando de inteligência no sentido mais completo — ou apenas de sistemas cada vez mais sofisticados em lidar com informação?

Saber muito não é o mesmo que pensar diferente

Apesar dos avanços impressionantes, os sistemas atuais compartilham uma característica fundamental: eles são extremamente eficientes em processar e organizar grandes volumes de dados. Na prática, funcionam como mecanismos altamente avançados de reconhecimento de padrões.

Isso permite respostas rápidas, coerentes e muitas vezes impressionantes. Mas há um limite claro. Diferente do pensamento humano, essas máquinas ainda não demonstram a capacidade de gerar ideias verdadeiramente originais ou de romper com estruturas já estabelecidas.

O desafio, portanto, não está apenas em aumentar a quantidade de dados ou o tamanho dos modelos. O ponto crítico é desenvolver uma forma de criatividade genuína. Na ciência, por exemplo, o avanço não ocorre apenas pela combinação de informações existentes, mas pela formulação de hipóteses que mudam completamente a forma de enxergar um problema.

Esse é o tipo de salto que ainda não foi alcançado — e que pode definir o que realmente significa chegar a um nível comparável ao humano.

Como medir algo que ainda não sabemos reproduzir

Uma das dificuldades centrais desse debate está em como avaliar esse tipo de inteligência. Os testes tradicionais não conseguem capturar a capacidade de descoberta ou inovação real.

Por isso, algumas propostas sugerem desafios mais complexos. Em vez de apenas responder perguntas, as máquinas teriam que “redescobrir” teorias fundamentais sem acesso direto aos dados históricos que levaram a essas conclusões.

A ideia não é reproduzir exatamente o caminho de grandes cientistas, mas verificar se o sistema consegue construir novas explicações a partir de informações incompletas. Esse tipo de tarefa exige um nível de abstração e criatividade muito mais elevado do que simplesmente reconhecer padrões.

Esse novo critério expõe uma limitação importante: se uma inteligência artificial depende exclusivamente do que já foi aprendido, sua capacidade de inovação continua restrita.

O próximo passo: simular o mundo e pensar com propósito

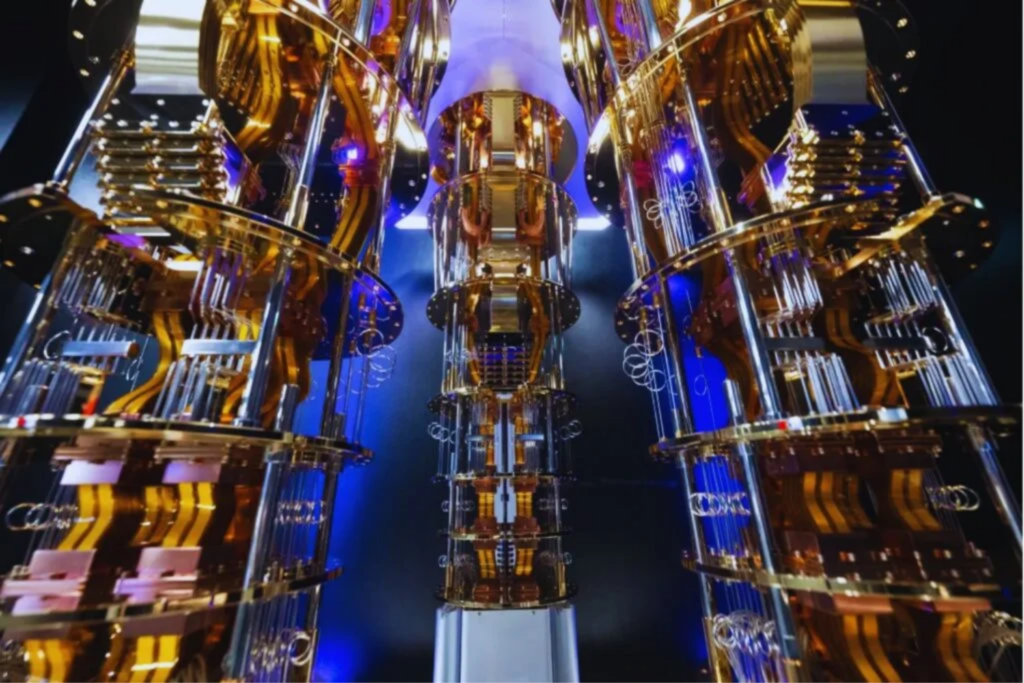

Outro desafio crucial envolve a integração de diferentes capacidades. Alguns sistemas já demonstraram habilidade em planejamento estratégico, enquanto outros se destacam na representação de linguagem, imagens e código.

O próximo passo seria unir essas competências em um único modelo. Isso significa criar sistemas capazes não apenas de descrever o mundo, mas de simulá-lo internamente. A partir dessa simulação, poderiam testar hipóteses, prever consequências e aprender com seus próprios erros.

Esse tipo de funcionamento se aproxima mais do que entendemos como pensamento. Não se trata apenas de responder corretamente, mas de desenvolver um processo ativo de raciocínio orientado por objetivos.

Por que essa previsão importa — mesmo que esteja errada

Prever datas exatas em tecnologia quase sempre envolve margem de erro. No entanto, o valor dessas estimativas não está apenas na precisão, mas na direção que apontam.

O fato de o debate estar migrando do poder computacional para a criatividade e a inovação indica uma mudança importante. A questão central deixou de ser “quanto a IA sabe” para se tornar “como ela pensa”.

Se esse novo nível será alcançado em cinco, dez ou quinze anos ainda é incerto. Mas há um consenso emergente: o avanço que falta não é apenas quantitativo, e sim qualitativo.

No fim das contas, o verdadeiro salto não será construir máquinas que saibam mais — e sim máquinas que consigam pensar de uma forma que, até agora, ainda é exclusivamente humana.