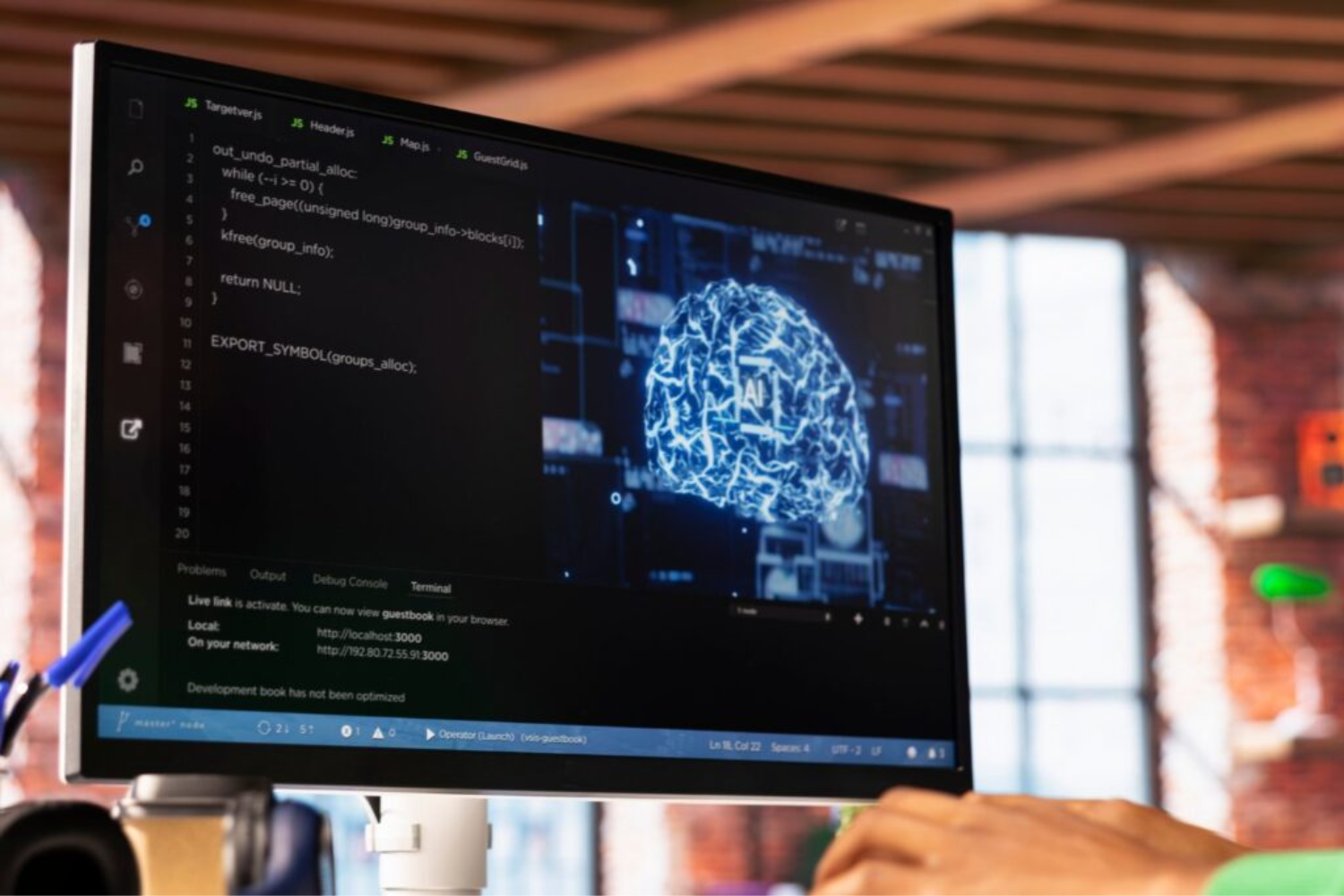

O desenvolvimento de uma inteligência artificial geral (AGI) é considerado o “Santo Graal” da tecnologia. Embora sistemas como os grandes modelos de linguagem já impressionem pela capacidade de gerar textos e interações, eles ainda estão muito longe de igualar a flexibilidade do cérebro humano. O desafio agora não é apenas melhorar resultados pontuais, mas integrar diferentes habilidades em um mesmo sistema de forma harmoniosa, algo que o cérebro faz naturalmente.

O cérebro como inspiração modular

Enquanto o cérebro funciona como uma rede de módulos especializados que cooperam, a maioria das IAs atuais atua como uma ferramenta única e rígida. Para superar essa limitação, empresas como OpenAI apostam nas chamadas arquiteturas mixture of experts, que distribuem tarefas entre diferentes módulos. Outras organizações, como Mistral e DeepSeek, seguem a mesma linha, buscando eficiência e flexibilidade.

O grande desafio, porém, é a integração: como fazer com que módulos de linguagem, memória ou lógica realmente se comuniquem entre si? Essa é a questão que ainda intriga especialistas, como aponta Anna Ivanova, do Instituto de Tecnologia da Geórgia.

Teoria do espaço global de trabalho

Uma das ideias mais influentes para explicar a consciência é a Global Workspace Theory (GWT), de Bernard Baars. Segundo ela, a mente funciona como um “palco central” em que diferentes módulos compartilham e priorizam informações. Esse mecanismo seria essencial para executar tarefas complexas em múltiplas etapas.

Pesquisas de Stanislas Dehaene reforçam essa hipótese, mostrando que a consciência humana é indispensável para certas atividades. Levar essa lógica para a IA implicaria em criar sistemas de coordenação estáveis, onde nenhum módulo se sobreponha de forma excessiva.

Avanços recentes na integração

Experimentos já começaram a mostrar resultados promissores. O modelo Perceiver, do Google DeepMind, conseguiu processar simultaneamente texto, imagens e áudio em um mesmo espaço, algo comparável ao conceito de GWT.

Outras iniciativas, como o projeto AI People da GoodAI, testam agentes virtuais capazes de combinar linguagem, memória e até simulações de emoções. Já Yann LeCun, da Meta, aposta em um “configurador” central que coordena diferentes módulos, mas sem recorrer ao conceito de consciência.

O debate sobre consciência em máquinas

A possibilidade de criar uma “consciência artificial” divide opiniões. Alguns pesquisadores acreditam que, com módulos interconectados e capacidade de auto-monitoramento, isso pode se tornar viável. Outros, como Anil K. Seth, da Universidade de Sussex, defendem que consciência está mais ligada ao fato de estar vivo do que à inteligência em si.

Nikolaus Kriegeskorte, da Universidade de Columbia, reforça que o cérebro humano ainda possui mecanismos que a engenharia não conseguiu replicar — e talvez nunca consiga.

O futuro ainda em aberto

A corrida pela AGI já mostrou que aquilo que é simples para humanos, como enxergar e interpretar o mundo, é extremamente difícil para máquinas. Por outro lado, tarefas complexas para nós, como o xadrez, são triviais para algoritmos.

Os especialistas concordam: inteligência não é uma habilidade única, mas a integração de muitas. Se a IA conseguir unir seus módulos em uma verdadeira arquitetura cooperativa, poderá se tornar uma parceira estratégica da humanidade. A grande questão, no entanto, continua em aberto: até que ponto essa integração será comparável à consciência emergente do cérebro humano?