A nova corrida tecnológica não é apenas por modelos maiores, mas por megawatts. A expansão da inteligência artificial generativa impulsiona uma demanda energética sem precedentes, e especialistas alertam que o gargalo não será computacional — será elétrico. Com projeções que apontam para consumo anual próximo de 1.000 TWh nos próximos anos, a IA pode pressionar sistemas elétricos, elevar emissões e exigir mudanças profundas em políticas energéticas. A pergunta central é inevitável: quem vai alimentar as máquinas do futuro?

Um salto energético nunca visto na tecnologia digital

A Agência Internacional de Energia (IEA) projeta que o consumo de data centers pode mais que dobrar até 2026, aproximando-se de 1.000 TWh ao ano — equivalente ao consumo elétrico do Japão. Em 2024, esses centros representaram 1,5% da eletricidade global; até 2030, podem dobrar essa fatia, segundo Nature. Some-se a isso o crescimento explosivo dos modelos generativos, e o cenário aponta para instalações individuais consumindo tanto quanto dezenas de milhares de residências.

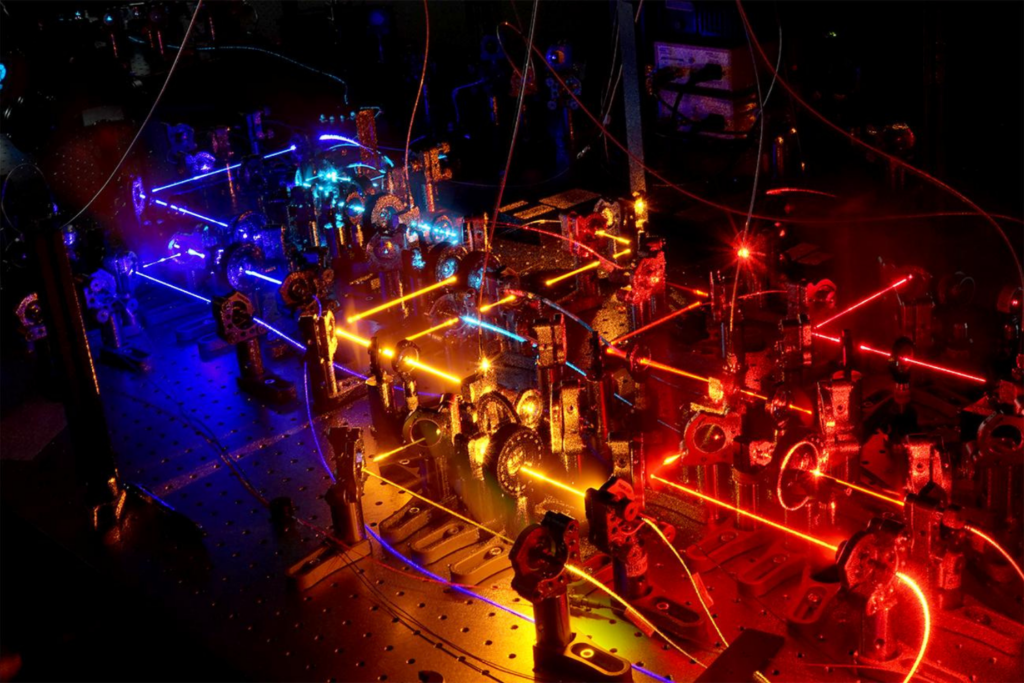

Cada interação com um modelo de IA aciona bilhões de operações em GPUs refrigeradas continuamente. Estimativas recentes sugerem que uma consulta média exige cerca de 0,3 Wh, número pequeno isoladamente, mas gigantesco quando multiplicado por bilhões de requisições diárias. É matemática simples: somas pequenas tornam-se montanhas energéticas em escala planetária.

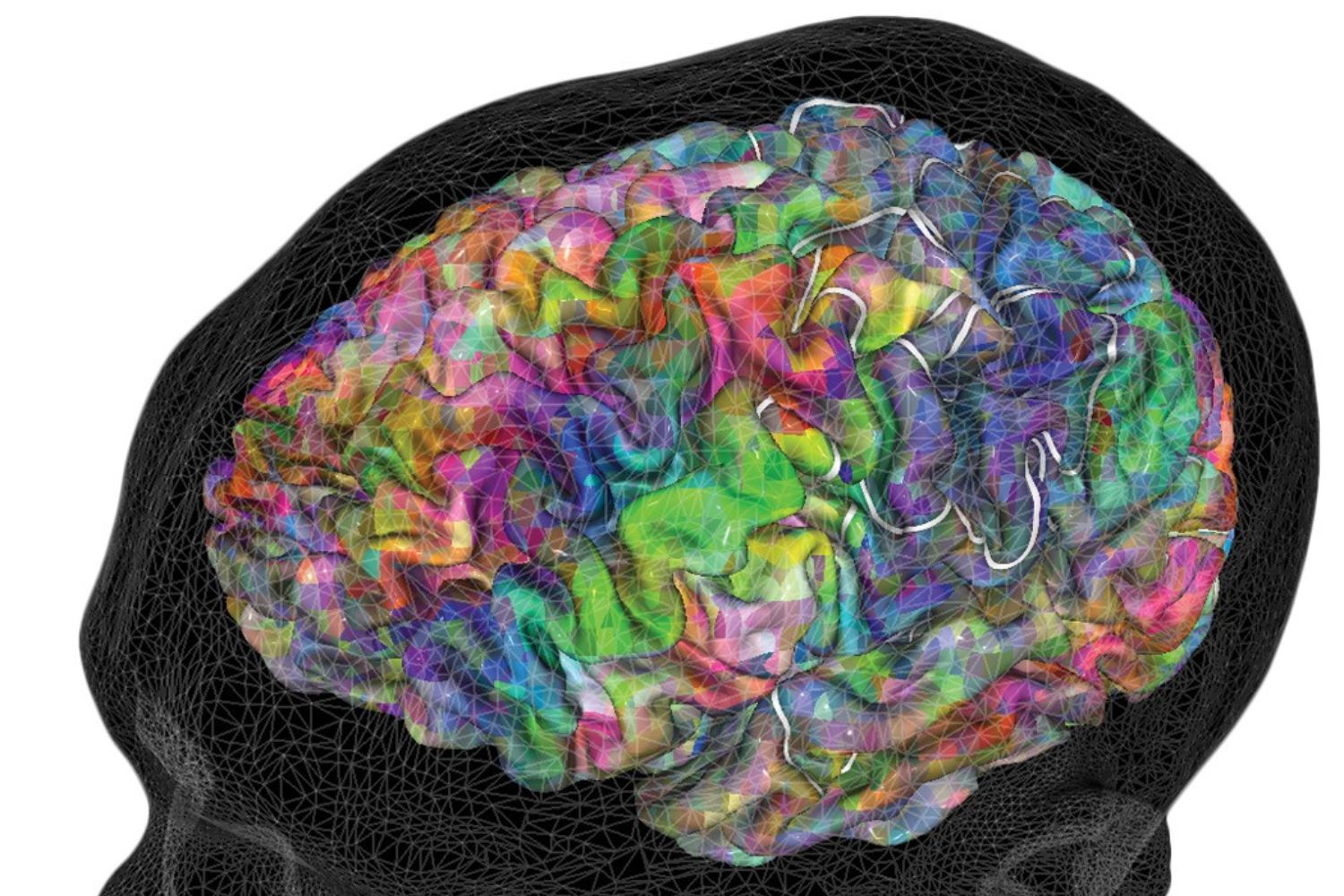

A comparação que incomoda: 20 watts versus terawatts

Enquanto supercomputadores exigem megawatts para treinar modelos, o cérebro humano executa raciocínio, criatividade, memória e tomada de decisões consumindo apenas 20 W — o mesmo que uma lâmpada fraca. São 80–100 bilhões de neurônios realizando tarefas para as quais precisamos ainda de fazendas de servidores. A inteligência biológica é, portanto, milhões de vezes mais eficiente.

A implicação é direta: não basta buscar mais poder computacional, precisamos buscar eficiência radical. Chips neuromórficos, algoritmos inspirados em redes biológicas e arquiteturas mais esparsas apontam o caminho, mas ainda estamos longe do cérebro.

Efeito rebote: eficiência pode aumentar o consumo total

A indústria aposta em compressão de modelos, hardware mais eficiente e sparsity — e nada disso é irrelevante. Contudo, a história energética mostra o chamado efeito rebote: reduzir o custo energético por tarefa tende a multiplicar o uso total. Se uma consulta custa menos, utilizaremos dez vezes mais.

Sem um sistema de orquestração da demanda, o consumo segue em curva ascendente. Isso inclui priorização de cargas críticas, execução em horários de baixa demanda e descentralização de processamento no edge.

O fornecimento também precisa mudar

A IEA e diversos estudos setoriais convergem: não basta instalar mais data centers — é preciso garantir energia firme e limpa. Isso implica:

- expansão massiva de eólica e solar com armazenamento,

- uso estratégico de energia nuclear avançada, onde viável,

- contratos de longo prazo (PPAs) para garantir fornecimento constante,

- redes mais inteligentes e com planejamento integrado.

Sem essa transição, a IA pode sobrecarregar sistemas elétricos, elevar tarifas e atrasar metas climáticas.

Três movimentos urgentes para governos e indústria

Pesquisadores defendem novos marcos regulatórios e métricas públicas para o setor. Entre as medidas prioritárias estão:

1) Transparência obrigatória

Centros de dados e serviços de IA devem informar consumo elétrico e hídrico (kWh e litros por 1.000 consultas, por exemplo). Sem dados comparáveis, não há competição responsável.

2) Condicionalidade para expansão

Novos parques de IA devem comprovar acesso a energia firme sem deslocar uso residencial ou industrial, e contratos com renováveis ou nuclear devem ser exigência mínima.

3) Eficiência como produto — não promessa

Modelos devem declarar intensidade energética por tarefa: tradução, resumo, geração multimodal, busca. Pesquisadores do MIT defendem padrões sustentáveis com cooling inteligente, scheduling de carbono e workloads otimizados.

Liderança em IA será definida por três eixos

Mais do que tamanho de modelo, vencerá quem dominar:

- eficiência neuralmente inspirada (neuromorfismo e redes parcimoniosas),

- portfólios energéticos sólidos e limpos,

- governança transparente da demanda computacional.

Porque a IA não vive “na nuvem” — vive em turbinas, reatores e transformadores. E, enquanto a tecnologia tenta imitar a inteligência humana, permanece o lembrete essencial: nossa mente roda com 20 watts. O futuro exigirá que a IA chegue o mais perto disso possível.

[ Fonte: Infobae ]