A inteligência artificial voltou ao centro do debate sobre segurança nacional após reportagens do The Wall Street Journal e da Fox News sugerirem que o modelo Claude, desenvolvido pela Anthropic, teria sido empregado em uma operação militar dos Estados Unidos na Venezuela.

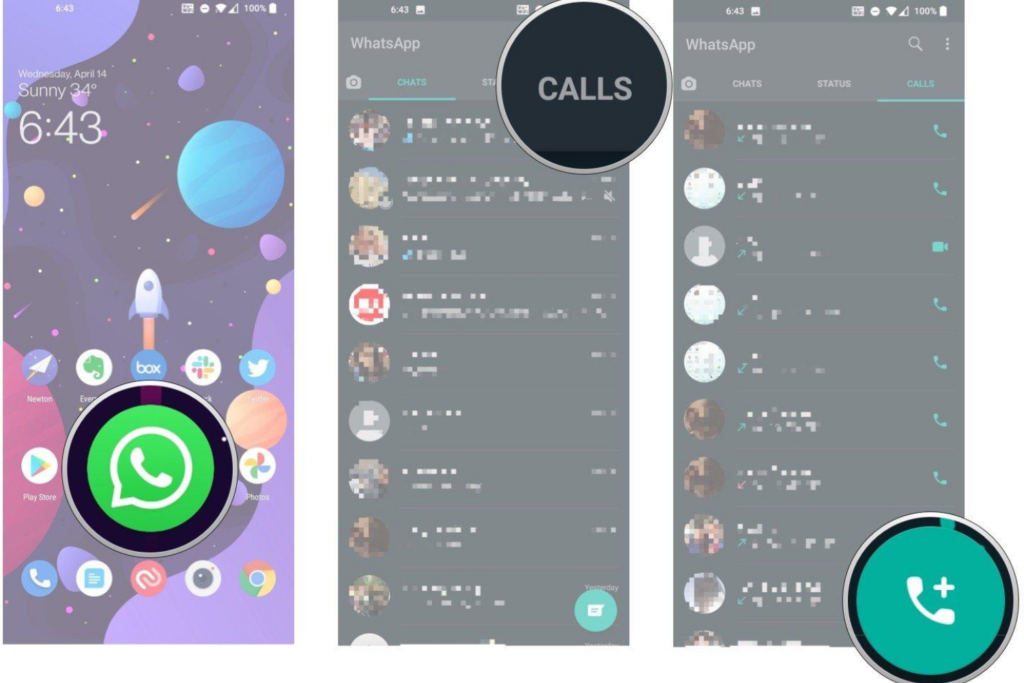

Segundo os relatos, a tecnologia poderia ter sido usada por meio de sistemas integrados da Palantir Technologies, tradicional fornecedora de soluções ao Departamento de Defesa dos EUA. Nem a Anthropic nem o Pentágono confirmaram oficialmente o uso do modelo em qualquer missão específica, citando protocolos de confidencialidade.

O que foi alegado

As reportagens afirmam que a ferramenta teria auxiliado em tarefas de análise e coordenação durante a operação que resultou na captura do ex-presidente venezuelano Nicolás Maduro e sua esposa, posteriormente levados aos Estados Unidos para enfrentar acusações ligadas ao narcotráfico.

Um porta-voz da Anthropic declarou que a empresa não comenta se Claude foi utilizado em operações classificadas ou não classificadas. Também reforçou que o uso da tecnologia deve seguir suas políticas internas, que proíbem explicitamente facilitar violência, desenvolver armamentos ou realizar vigilância indevida.

Contrato bilionário sob pressão

O caso ocorre em meio a tensões políticas envolvendo o contrato firmado entre a Anthropic e o Departamento de Defesa, estimado em até US$ 200 milhões.

De acordo com o The Wall Street Journal, integrantes da administração americana avaliam o futuro do acordo, especialmente diante da postura pública da empresa em favor de regulações mais rígidas para o uso militar da IA.

O CEO da Anthropic, Dario Amodei, já defendeu limites regulatórios para evitar que modelos avançados sejam empregados em sistemas letais autônomos ou vigilância doméstica sem supervisão adequada.

IA na guerra: fronteira em rápida expansão

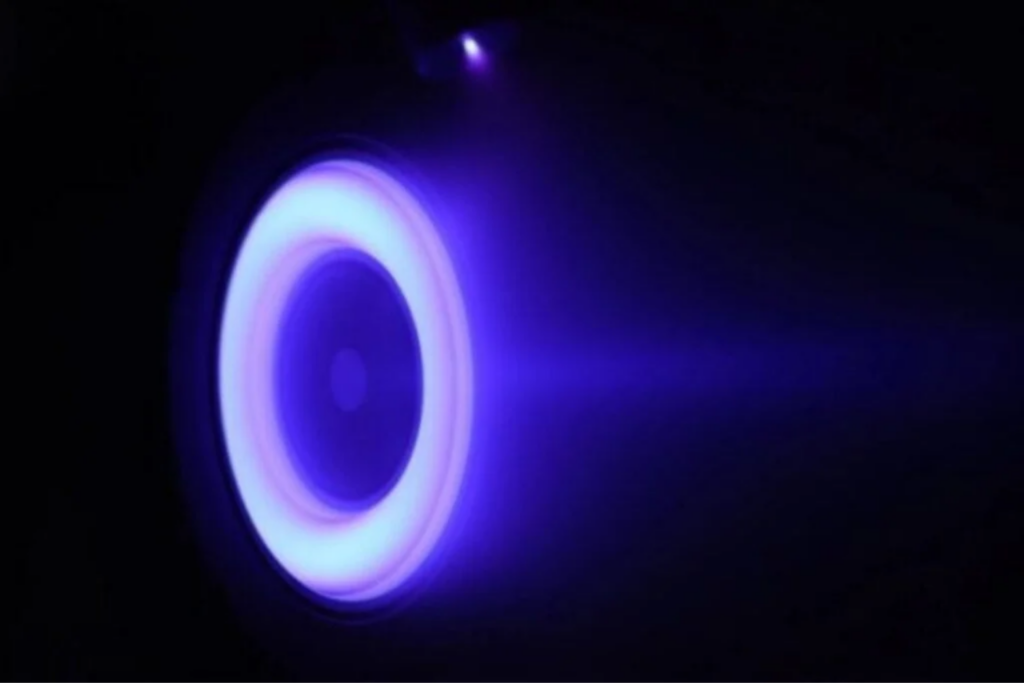

A Anthropic foi uma das primeiras desenvolvedoras de IA a firmar contratos para operações classificadas com o Departamento de Defesa dos EUA. Modelos como Claude podem ser usados para sintetizar grandes volumes de documentos, analisar inteligência, apoiar planejamento estratégico e até auxiliar na coordenação de sistemas autônomos.

O setor, porém, é altamente competitivo. Empresas como a Google e a OpenAI também disputam espaço em aplicações militares, oferecendo plataformas voltadas a análise de dados e geração de relatórios para forças armadas.

Em declarações recentes, o secretário de Defesa dos EUA, Pete Hegseth, afirmou que o país não utilizará modelos de IA que imponham restrições que impeçam sua aplicação em cenários de guerra — sinalizando possíveis divergências entre fornecedores de tecnologia e autoridades militares.

Questões éticas e regulatórias

O uso de IA em operações militares levanta questões profundas sobre responsabilidade, controle e transparência. Embora empresas afirmem monitorar o uso de seus modelos, o ambiente classificado de segurança nacional dificulta verificação externa.

Além disso, especialistas alertam para o risco de escalada tecnológica, na qual pressões geopolíticas incentivam flexibilizações regulatórias para acompanhar adversários estratégicos.

Se confirmado, o episódio envolvendo Claude marcaria mais um passo na integração de inteligência artificial em operações de defesa. Mas também evidencia a tensão entre inovação tecnológica, responsabilidade ética e interesses estratégicos.

A discussão sobre o papel da IA no futuro da guerra está longe de terminar — e casos como este tendem a intensificar o debate público sobre limites e governança dessas tecnologias.

[ Fonte: Infobae ]