Durante anos, robôs e veículos autônomos enxergaram o mundo de forma bastante limitada. Mesmo equipados com sensores avançados, eles interpretavam ambientes como conjuntos frios de pontos, distâncias e formas geométricas em tons de cinza. Agora, uma nova tecnologia começou a mudar essa lógica de maneira radical. Pesquisadores e engenheiros desenvolveram um sistema capaz de aproximar a percepção das máquinas da maneira como humanos realmente enxergam o ambiente: combinando profundidade, cor, contexto e movimento ao mesmo tempo.

A tecnologia que mudou a forma como máquinas percebem o ambiente

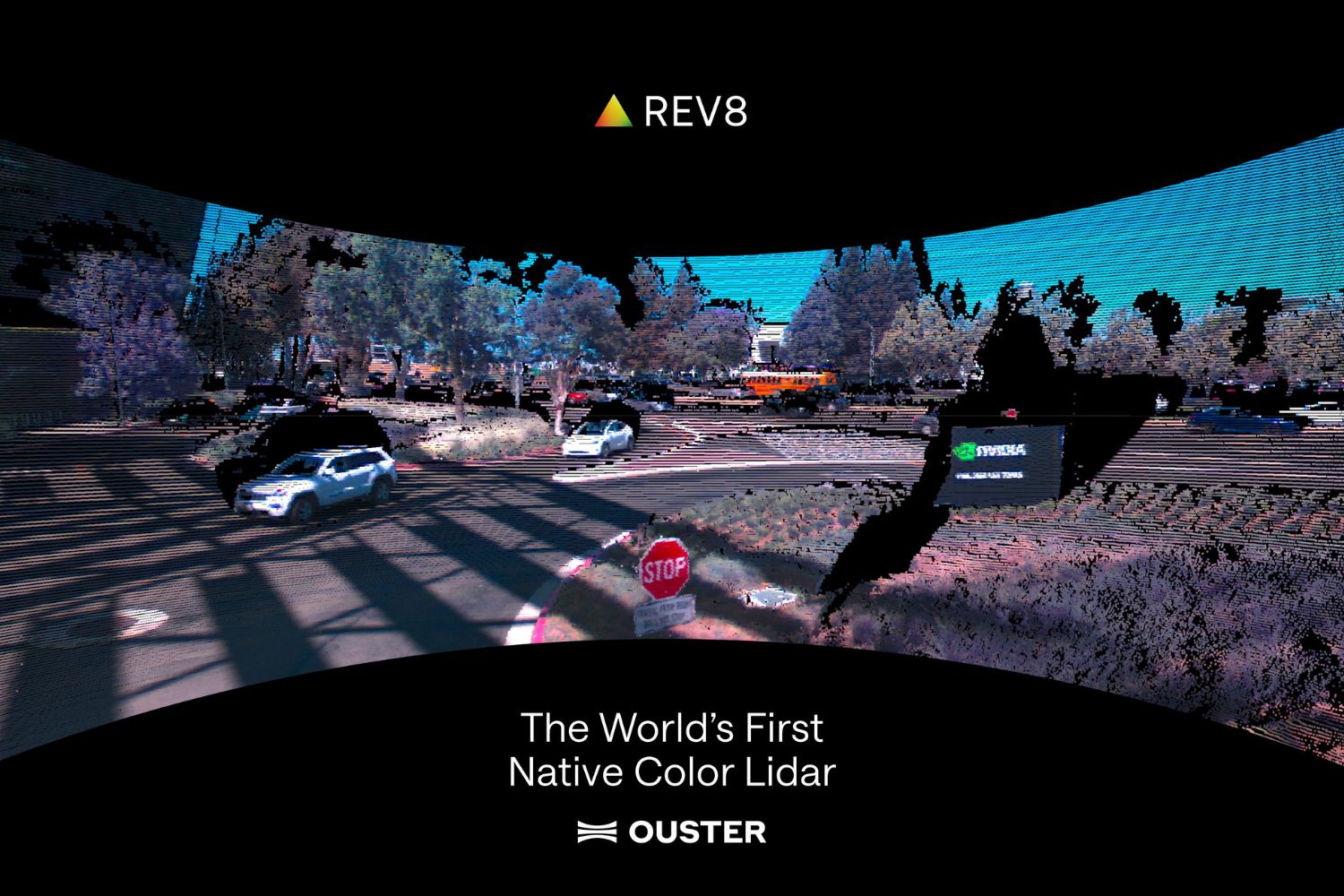

A empresa Ouster apresentou recentemente uma nova geração de sensores LiDAR chamada Rev8 OS, descrita como um dos primeiros sistemas capazes de capturar informações de cor diretamente em cada ponto de uma imagem tridimensional.

Na prática, isso significa que robôs e veículos autônomos deixam de interpretar o mundo apenas como um conjunto de estruturas em preto e branco.

Agora, cada ponto da chamada “nuvem 3D” também carrega informações completas de cor.

Pode parecer um detalhe pequeno, mas para sistemas de inteligência artificial isso representa uma mudança enorme.

Até então, robôs precisavam combinar dados de diferentes sensores para compreender o ambiente. Um sistema LiDAR fornecia profundidade e distância, enquanto câmeras externas eram responsáveis pelas cores e detalhes visuais.

Esse processo exigia sincronização constante e podia gerar atrasos, falhas de calibração e erros de interpretação.

Com a nova tecnologia, tudo passa a ser capturado simultaneamente no mesmo fluxo de dados.

Segundo a empresa, isso permite que máquinas interpretem ambientes complexos de maneira muito mais rápida e natural.

Como funciona a “visão” desses novos robôs

A base da tecnologia continua sendo o LiDAR, sistema que utiliza feixes de laser para medir distâncias e criar mapas tridimensionais extremamente precisos.

Esses sensores calculam quanto tempo a luz leva para atingir um objeto e retornar ao dispositivo.

A partir disso, o sistema consegue determinar posição, formato e profundidade de praticamente tudo ao redor.

A grande novidade está justamente na integração da cor.

Em vez de depender de câmeras separadas, cada ponto medido pelo sensor já nasce acompanhado de informações visuais completas.

Isso cria uma representação muito mais rica do ambiente.

Segundo os desenvolvedores, o resultado aproxima a percepção robótica da maneira como seres humanos reconhecem objetos, placas, superfícies e movimentos no mundo real.

Na prática, um robô deixa de “ver” apenas formas abstratas e passa a interpretar sinais visuais com muito mais contexto.

Isso pode ajudar sistemas autônomos a identificar placas de trânsito, luzes de freio, obstáculos e diferenças entre superfícies com muito mais precisão.

O sensor que promete enxergar até em condições extremas

O principal modelo da nova linha, chamado OS1 Max, foi projetado para ambientes considerados particularmente difíceis para sensores tradicionais.

Segundo os dados técnicos divulgados pela empresa, o sistema utiliza arquitetura de 256 canais e pode alcançar distâncias de até 200 metros mesmo em objetos com baixa refletividade.

Em condições ideais, o alcance pode chegar a impressionantes 500 metros.

Além disso, o equipamento foi desenvolvido para funcionar tanto em ambientes extremamente escuros quanto sob luz solar intensa.

A nova arquitetura de chips utilizada no sistema recebeu os nomes L4 e L4 Max.

De acordo com a Ouster, ela combina tecnologias avançadas de processamento com sistemas de ciência de cor desenvolvidos pela Fujifilm.

O objetivo é permitir leitura espacial extremamente rápida e precisa, reduzindo falhas de interpretação em cenários complexos.

A empresa afirma que o desempenho chega a dobrar em comparação com gerações anteriores de sensores LiDAR.

O avanço que pode acelerar a chamada “IA física”

A evolução desses sensores faz parte de um movimento maior dentro da indústria tecnológica chamado de “Physical AI”, ou inteligência artificial física.

A ideia é desenvolver máquinas capazes de interagir com o ambiente de forma cada vez mais parecida com a percepção humana.

Isso envolve não apenas reconhecer objetos, mas compreender contexto, profundidade, movimento e mudanças no espaço em tempo real.

Robôs industriais, carros autônomos, sistemas de logística e até máquinas usadas em infraestrutura urbana podem se beneficiar dessa nova geração de percepção espacial.

Quanto mais natural for a interpretação do ambiente, mais eficiente tende a ser a tomada de decisões automatizadas.

Segundo especialistas do setor, um dos maiores desafios da robótica moderna não é apenas criar inteligência artificial avançada, mas permitir que ela compreenda o mundo físico com precisão suficiente para agir com segurança.

E é justamente aí que tecnologias como essa começam a ganhar importância estratégica.

O futuro da robótica pode depender dessa nova forma de enxergar

A Ouster afirma que já trabalha com empresas ligadas a setores como mobilidade autônoma, robótica e infraestrutura inteligente.

Entre os nomes citados estão gigantes como Google e Volvo Autonomous Solutions.

A empresa também anunciou recentemente a aquisição da StereoLabs, reforçando sua estratégia de unificar percepção por câmera e LiDAR em uma única plataforma integrada.

Embora ainda existam desafios importantes relacionados a custo, processamento de dados e adaptação industrial, o avanço sinaliza uma mudança importante na evolução da robótica.

Por muitos anos, máquinas enxergaram o mundo como mapas geométricos frios e incompletos.

Agora, elas começam a perceber profundidade, cores e contexto quase da mesma forma que humanos fazem.

E isso pode ser um dos passos mais importantes rumo a sistemas autônomos muito mais sofisticados — e talvez mais próximos da inteligência humana do que imaginávamos.

[Fonte: Olhar digital]