Nem todos os vazamentos acontecem por ataques sofisticados ou falhas de segurança complexas. Às vezes, basta um erro humano para abrir uma janela inesperada. E, quando isso acontece em uma das empresas mais observadas do setor de inteligência artificial, o resultado vai muito além do constrangimento momentâneo. Foi exatamente isso que ocorreu recentemente, em um episódio que deixou desenvolvedores atentos — e levantou questões interessantes sobre o que está por vir.

Quando um erro vira um mapa do futuro

Tudo começou de forma quase banal. Um repositório público foi exposto por engano, permitindo que desenvolvedores acessassem uma grande quantidade de código interno de uma ferramenta ainda em evolução.

O que parecia apenas um incidente técnico rapidamente se transformou em algo muito mais relevante. Dentro desse material, havia centenas de milhares de linhas de código, organizadas em milhares de arquivos — um volume suficiente para revelar não apenas como a ferramenta funciona hoje, mas também pistas claras sobre o que está sendo desenvolvido.

A ferramenta em questão, conhecida como Claude Code, pertence à empresa Anthropic. E o que ficou evidente logo nas primeiras análises é que ela vai muito além de um simples assistente de programação.

Diferente de um chatbot tradicional que responde perguntas ou sugere trechos de código, esse sistema parece operar como uma espécie de núcleo ativo dentro do ambiente de desenvolvimento. Ele não apenas interpreta comandos, mas também executa ações, manipula arquivos e acompanha o fluxo de trabalho em tempo real.

Entre as funcionalidades identificadas estão dezenas de comandos internos e múltiplos tipos de ações automatizadas, incluindo leitura, edição e execução de código. Isso sugere uma mudança importante: a transição de assistentes passivos para agentes com capacidade real de intervenção.

O que o código revelou sobre o que ainda não foi anunciado

Se o funcionamento atual já chama atenção, o que realmente despertou curiosidade foram os indícios do futuro escondidos no próprio código.

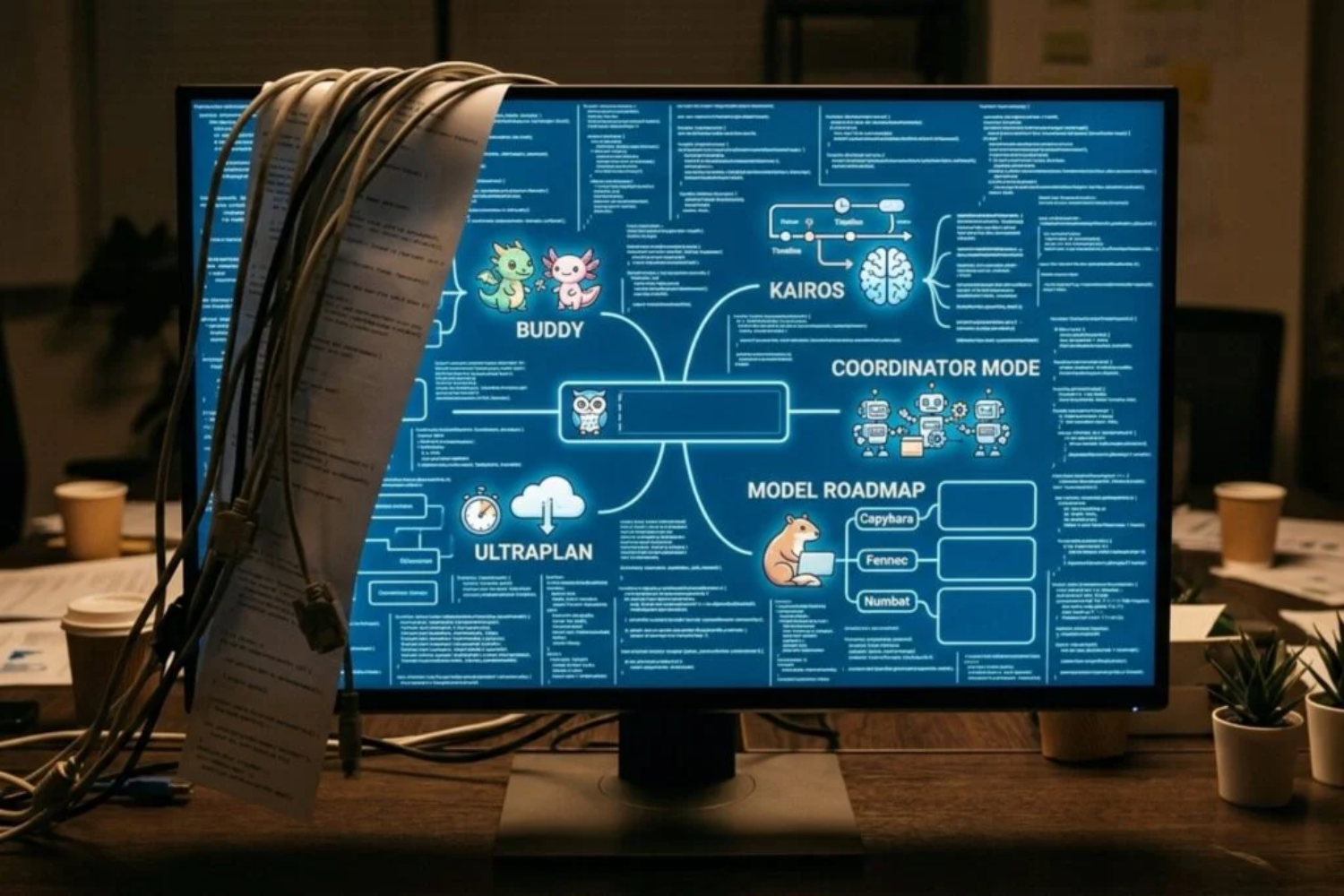

Entre eles, surgiu o nome “Buddy”, descrito como uma espécie de companheiro virtual integrado à interface. Com múltiplas variações visuais — algumas até inusitadas — a proposta parece ir além da utilidade pura, explorando uma presença mais constante e até emocional dentro da experiência do usuário.

Mas a funcionalidade mais intrigante atende por outro nome: “Kairos”.

De acordo com as descrições encontradas, trata-se de um sistema que atuaria continuamente em segundo plano, acompanhando decisões do usuário, identificando mudanças no código e registrando o contexto da sessão. Ao final, ele organizaria essas informações para facilitar interações futuras.

Na prática, isso aponta para algo maior do que uma simples melhoria incremental. É um passo em direção a sistemas que não apenas respondem, mas também constroem memória, entendem processos longos e mantêm continuidade entre sessões.

Outro elemento identificado foi o chamado “Ultraplan”, associado a sessões de planejamento na nuvem, além de um modo em que múltiplos agentes poderiam ser coordenados simultaneamente.

Esse conjunto de funções revela uma tendência clara: a evolução de ferramentas que deixam de executar tarefas isoladas para atuar como sistemas capazes de organizar fluxos complexos de trabalho.

— Chaofan Shou (@Fried_rice) March 31, 2026

Muito além de um vazamento: o que isso diz sobre a indústria

O episódio também trouxe à tona nomes de modelos ainda não anunciados oficialmente, sugerindo que a empresa trabalha em novas versões e experimentações internas.

Embora não haja confirmação de que todos esses projetos chegarão ao público, o conjunto de evidências reforça uma percepção crescente: o ecossistema de inteligência artificial está se expandindo rapidamente para além do formato tradicional de chat.

A própria Anthropic afirmou que o incidente foi resultado de um erro humano durante a publicação de um pacote e destacou que não houve exposição de dados sensíveis de usuários.

Ainda assim, o impacto vai além da falha técnica.

Esse tipo de situação revela algo mais profundo sobre o momento atual da indústria. À medida que as ferramentas se tornam mais complexas, autônomas e integradas ao trabalho cotidiano, a responsabilidade operacional cresce na mesma proporção.

Não se trata apenas de construir sistemas poderosos, mas de garantir que todo o ecossistema ao redor deles funcione com o mesmo nível de precisão.

No fim das contas, o que vazou não foi apenas código.

Foi uma visão — ainda incompleta, mas suficientemente clara para mostrar que o futuro da IA pode ser menos sobre respostas rápidas e mais sobre presença contínua, memória e colaboração inteligente.

E, nesse cenário, até um erro acidental pode acabar revelando mais do que qualquer anúncio planejado.