Estudos recentes revelam que grande parte do tráfego online já é gerado por bots e sistemas de IA que replicam padrões virais. A consequência é uma rede mais ruidosa, onde a informação evolui em cascatas automáticas. O desafio passa a ser ético e regulatório: exigir responsabilidade e transparência de quem cria e lucra com essas tecnologias.

A relação entre criador e criatura sempre foi marcada pelo medo de perder o controle, como lembrava Mary Shelley em Frankenstein. No século XXI, esse temor se reflete na proliferação de conteúdos gerados por inteligência artificial. Para muitos especialistas, a chamada “internet morta” — dominada por repetições e automatismos — já não é teoria conspiratória, mas sim o novo cenário digital.

Do mito ao feed sem vida

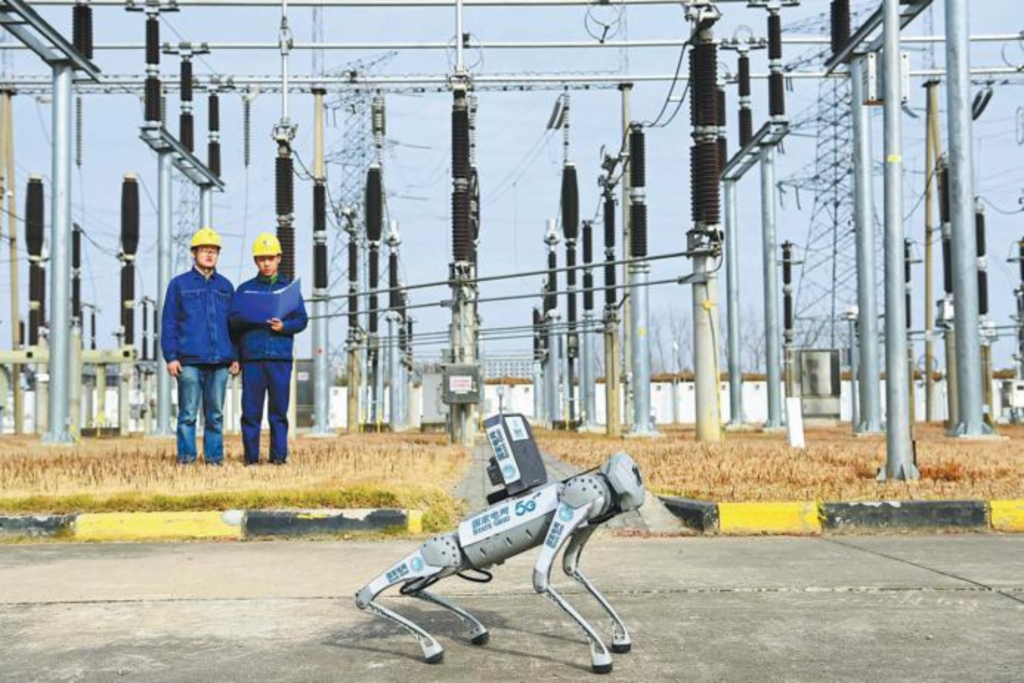

Pesquisadores da UNSW Sydney e da Universidade de Melbourne alertam que redes sociais, fonte primária de informação para milhões, estão repletas de contas geridas por IA que acumulam seguidores e credibilidade. Segundo a Imperva, quase metade do tráfego da internet já era composto por bots há dois anos.

Aaron Harris, da Sage, propõe mudar a lente de análise: mais importante do que distinguir entre humano ou máquina é garantir mecanismos de filtragem, verificação e rastreabilidade. Afinal, se o feed já é povoado por automatismos, a pergunta essencial é quem assume a responsabilidade pelo que circula.

Cascatas que se retroalimentam

Um estudo da Universidade de Vermont e do Instituto Santa Fe, publicado em Physical Review Letters, descreve as Self-Reinforcing Cascades: fenômenos em que mensagens se transformam à medida que se espalham, como incêndios informativos que ganham intensidade em redes densas. Não se trata apenas de quantidade de conteúdo, mas da evolução da própria mensagem.

Paralelamente, pesquisa apresentada na USENIX analisou assistentes generativos e mostrou como eles podem segmentar a influência. O pesquisador Luca Luceri (USC) destacou a chamada “paradoxo da suscetibilidade”: em média, os amigos de um usuário são mais influenciáveis que ele próprio. Essa lógica facilita prever quem vai compartilhar o quê, impulsionando ainda mais a viralização automática.

Entre ética e transparência

Para além do pânico, especialistas defendem regras claras. O Google DeepMind apresentou em A ética dos assistentes avançados de IA um quadro de responsabilidade em quatro dimensões — assistente, usuário, desenvolvedor e sociedade. Entre os princípios estão “não manipular”, “não impor custos sociais” e “não restringir indevidamente a liberdade”.

Harris reforça que a saída é prática: etiquetagem transparente de conteúdos gerados por IA, sistemas auditáveis e explicáveis. A “internet morta” não se combate tentando voltar ao passado, mas impondo responsabilidade e consequências a quem cria e opera tais tecnologias.

Se a inteligência artificial já é parte do tecido digital, o desafio passa a ser convivência responsável. A solução tem nome simples — transparência — mas aplicação complexa. No fim, não se trata apenas de tecnologia, mas de confiança social: quem responde pelo que lemos, vemos e compartilhamos online.