A inteligência artificial está deixando de ser apenas uma curiosidade tecnológica para se tornar parte ativa da vida pública — inclusive na administração de serviços essenciais. Na Europa, e também no Brasil, cresce o uso de ferramentas como o ChatGPT em prefeituras, escolas e até hospitais. Mas até que ponto estamos preparados para delegar decisões a máquinas? E, principalmente: quem será responsabilizado quando algo der errado?

A IA está entrando nos gabinetes do setor público

Em cidades como Bétera, na Espanha, a prefeitura já utiliza o ChatGPT para agilizar tarefas e redigir relatórios. O ganho de produtividade relatado chega a 20%. No entanto, o uso não está restrito à Europa. Também no Brasil, órgãos públicos começam a testar soluções de IA, sem que exista uma regulamentação clara sobre como, quando e por quem essas tecnologias devem ser utilizadas.

O problema é que esse avanço vem ocorrendo mais rápido do que a criação de normas. Nem mesmo juízes, professores ou médicos têm diretrizes bem definidas sobre o uso de IA em suas rotinas. Isso abre brechas perigosas que podem afetar diretamente a população.

Erros, decisões equivocadas e falta de supervisão

Casos concretos já mostram os perigos desse uso indiscriminado. Na Espanha, a Polícia Nacional utilizou sistemas de IA para identificar denúncias falsas e transcrever interrogatórios. Os erros foram tantos que geraram desde situações absurdas até ameaças à integridade de pessoas envolvidas.

O caso mais grave foi o do sistema VioGén, voltado à gestão de casos de violência de gênero. Falhas no algoritmo causaram decisões incorretas e, em alguns casos, resultados trágicos. Sem supervisão humana constante, confiar cegamente na IA pode custar vidas.

Privacidade em risco: para onde vão os dados?

Quando funcionários públicos usam IA para resumir ou analisar documentos sigilosos, surge uma dúvida séria: esses dados estão realmente protegidos? A maioria ainda utiliza versões gratuitas ou padrões dessas ferramentas, que podem armazenar informações e expô-las involuntariamente.

Mesmo com versões empresariais que prometem não reter dados (como o ChatGPT Enterprise), o risco de vazamentos ainda existe. Isso coloca o cidadão comum em uma situação de extrema vulnerabilidade — muitas vezes, sem seu conhecimento ou consentimento.

Falta de regulação e responsabilidade difusa

Em março de 2025, a Espanha aprovou um projeto de lei sobre o uso ético da IA. Apesar de seguir a diretriz europeia, o texto foi surpreendentemente brando com os órgãos públicos: punições leves, ausência de limites definidos e pouca clareza sobre a responsabilidade em caso de erro.

E no Brasil, a situação é semelhante: discussões sobre regulação ainda são superficiais e não acompanham o avanço tecnológico nos serviços públicos.

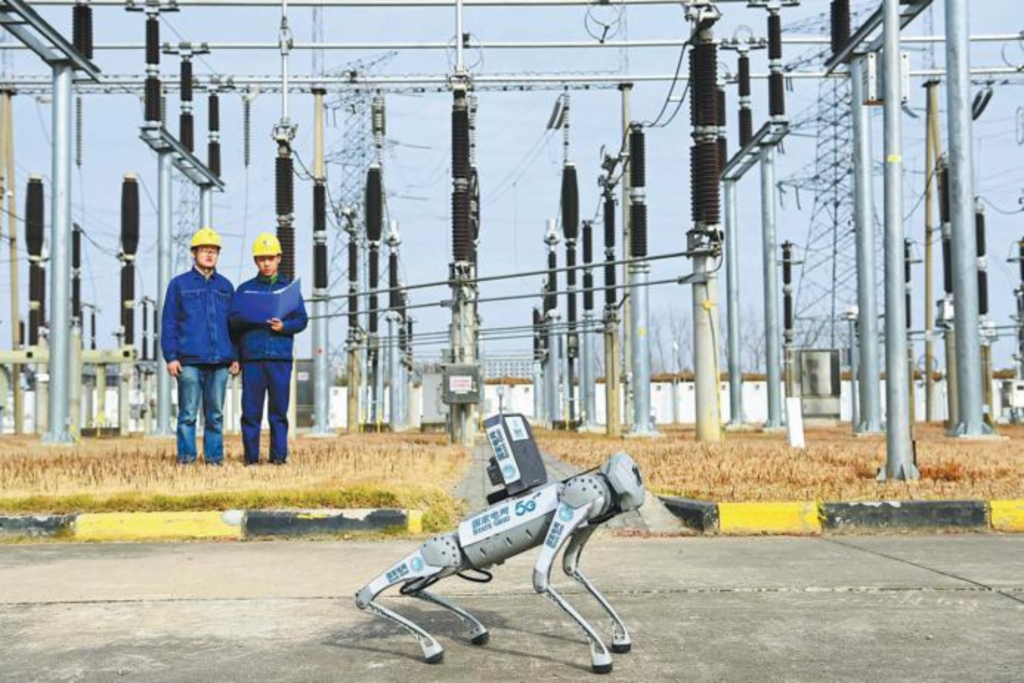

Modernização sim, mas com cautela

A IA pode ser uma aliada poderosa para tornar a gestão pública mais eficiente. Mas isso só será possível com planejamento sério, capacitação dos profissionais, supervisão constante e leis rigorosas que protejam o cidadão.

Sem esses pilares, corremos o risco de entregar decisões delicadas a sistemas que não entendemos completamente — e que, quando falham, não respondem por seus erros.