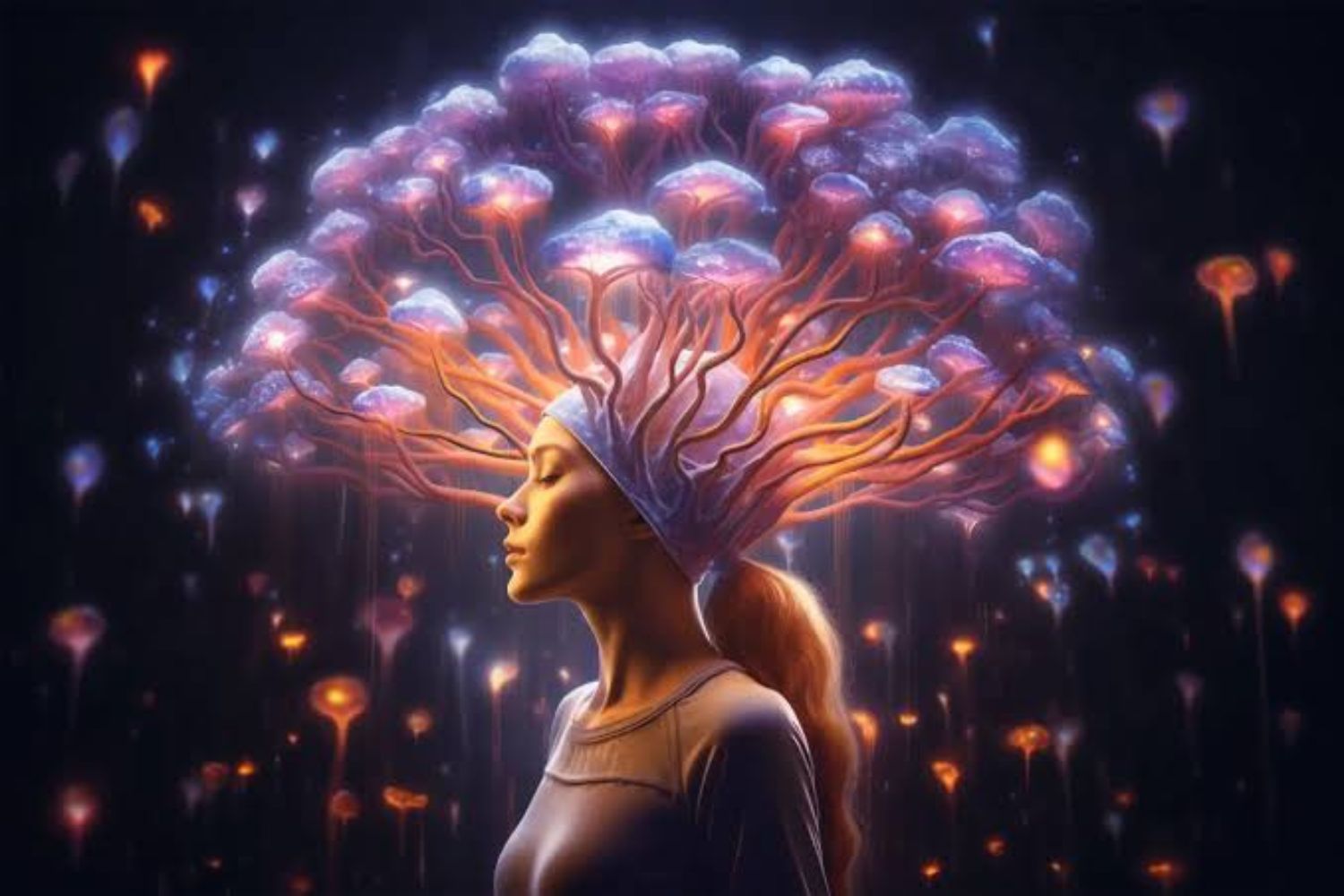

O método não interpreta apenas palavras: ele transforma imagens mentais em descrições detalhadas. E isso abre portas promissoras — e um enorme alerta ético.

Como a IA traduziu pensamentos pela primeira vez

O estudo, publicado na Science Advances, foi conduzido por Tomoyasu Horikawa, do laboratório de neurociência da NTT, em Tóquio. Ele queria descobrir se era possível converter atividade cerebral em frases completas.

Se antes estudos conseguiam decodificar palavras pensadas, transformar imagens complexas em linguagem sempre foi um desafio.

A solução foi uma técnica chamada “legendagem mental”, que usa modelos de linguagem e ressonância para descrever o que alguém está imaginando ou lembrando.

Como funciona a tal “legendagem mental”

O processo pode parecer bruxaria, mas é pura engenharia de dados:

– Seis voluntários tiveram seus cérebros escaneados enquanto assistiam a 2.180 videoclipes curtos.

– As legendas desses vídeos foram convertidas em vetores numéricos por modelos de linguagem.

– Horikawa treinou “decodificadores”, IAs mais simples, para relacionar padrões de ressonância magnética com esses vetores.

– Depois, ele pediu que os voluntários assistissem ou lembrassem vídeos que a IA nunca tinha visto antes.

– Um segundo algoritmo gerava frases em inglês que melhor correspondiam àquela atividade neural.

Resultado: a IA começou a produzir descrições coerentes sobre objetos, cenários e ações presentes nos vídeos — mesmo sem acessar regiões cerebrais ligadas à linguagem.

Isso significa que o sistema funciona mesmo em pessoas que perderam a capacidade de falar.

Para quem isso pode mudar tudo

De acordo com Horikawa e outros especialistas, a tecnologia pode ajudar pessoas com:

- afasia (incapacidade de falar);

- ELA (doença que afeta comunicação);

- condições neurológicas que bloqueiam a fala;

- autismo não verbal.

“É um passo enorme rumo a interfaces cérebro–máquina realmente assistivas”, disse à CNN o psicólogo Scott Barry Kaufman.

Marcello Ienca, especialista em ética de IA, foi direto: “É um avanço legítimo rumo à leitura da mente”.

O alerta ético: privacidade mental em risco

E é aqui que o entusiasmo vira preocupação.

A possibilidade de traduzir pensamentos — mesmo que parcialmente — levanta questões sérias:

- Como impedir que empresas acessem esses dados?

- Como proteger informações íntimas que nem verbalizamos?

- O que impediria governos ou corporações de usar a tecnologia sem consentimento?

“Estamos diante do desafio máximo da privacidade”, afirma Ienca.

Ele lembra que empresas como Neuralink já prometem interfaces neurais comerciais, o que exige regras rígidas sobre acesso ao cérebro humano.

Pesquisadores em neuroética defendem:

– consentimento explícito para cada uso;

– tratamento de dados neurais como altamente sensíveis;

– processamento local (sem nuvem);

– mecanismos de desbloqueio controlados pelo usuário.

Ainda não é leitura total da mente — e talvez nunca seja

Apesar dos avanços, Horikawa destaca que a tecnologia tem muitas limitações:

– precisa de enormes quantidades de dados individuais;

– exige cooperação total do usuário;

– não consegue decodificar pensamentos complexos ou improváveis;

– funciona apenas com padrões aprendidos durante o treinamento.

Ou seja: apesar do medo popular, essa IA não lê pensamentos privados do nada. Ela só traduz aquilo para o qual foi treinada.

Mesmo assim, o estudo mostra que a fronteira entre cérebro e máquina está ficando cada vez mais tênue.

O futuro da leitura neural — esperança ou risco?

A combinação de IA, pensamentos e ressonância magnética pode revolucionar a comunicação humana, especialmente para quem não consegue falar.

Mas também pode abrir portas perigosas se usada fora da medicina.

A pergunta é inevitável: estamos preparados para uma tecnologia que toca o limite entre privacidade e consciência?

A ciência já deu seu passo. Agora, a sociedade precisa decidir como — e se — queremos continuar avançando.

[Fonte: CNN Brasil]