A inteligência artificial já consegue explicar praticamente qualquer conceito. Mas entender nem sempre significa visualizar. Pensando nisso, o Google deu um passo além ao transformar o Gemini em uma ferramenta interativa capaz de gerar simulações dinâmicas e modelos 3D manipuláveis. A novidade aproxima a IA de um laboratório virtual, onde o usuário não apenas aprende, mas experimenta.

A nova aposta do Google: interatividade total

Até pouco tempo atrás, assistentes de IA eram limitados a respostas em texto, imagens estáticas ou, no máximo, gráficos simples. Com a nova atualização do Gemini, isso muda completamente.

Agora, o usuário pode solicitar simulações completas e interagir com elas em tempo real. Isso significa girar objetos, alterar variáveis, pausar animações e observar diferentes cenários a partir de múltiplos ângulos.

Um exemplo simples: ao pedir uma simulação da órbita da Lua, é possível ajustar a velocidade, ocultar trajetórias ou analisar o movimento sob diferentes perspectivas. A experiência deixa de ser passiva e passa a ser exploratória.

Aprender fazendo: o impacto na educação

Essa mudança tem um efeito direto no aprendizado. Conceitos que antes exigiam muita abstração agora podem ser visualizados e testados na prática.

Estudantes podem explorar fenômenos como gravidade, ondas sonoras ou reações químicas ajustando parâmetros e observando os resultados instantaneamente. Para professores, isso transforma a aula em algo mais dinâmico e intuitivo.

A lógica é semelhante à de um livro didático interativo — só que com infinitas possibilidades. Cada pergunta pode gerar uma nova experiência visual, adaptada ao que o usuário quer entender.

Uma ferramenta poderosa para profissionais

O impacto não se limita à educação. Para engenheiros, designers e pesquisadores, o Gemini passa a funcionar como uma ferramenta de prototipagem rápida.

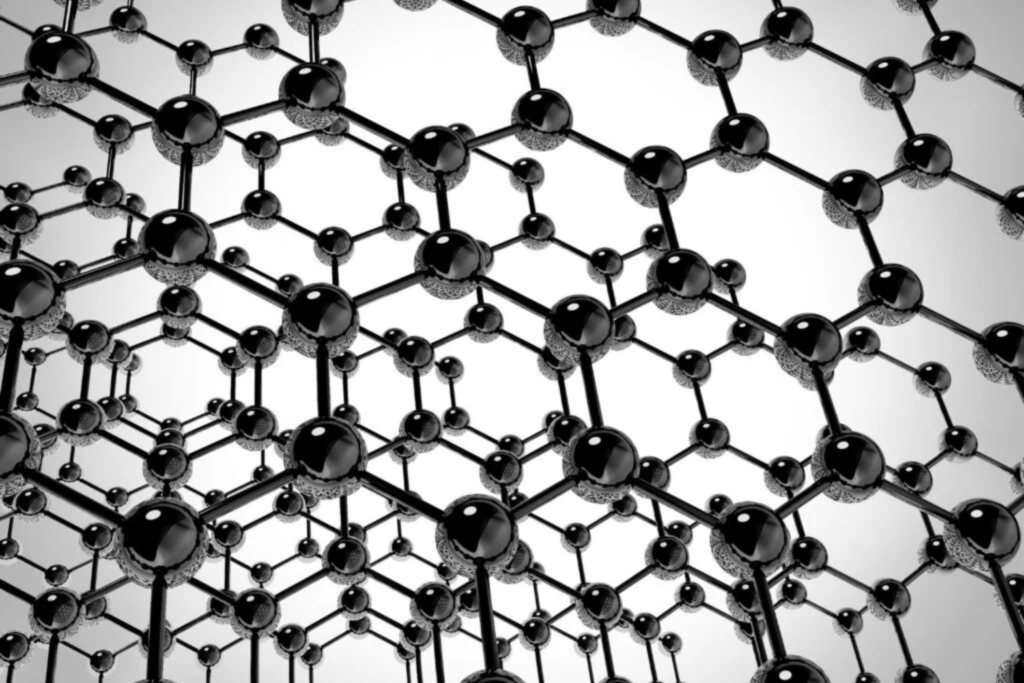

Com uma simples descrição, é possível gerar um modelo tridimensional de um objeto, sistema ou estrutura. Esse modelo pode ser analisado, modificado e explorado em tempo real, o que agiliza o desenvolvimento de ideias e a comunicação de conceitos técnicos.

Isso reduz etapas, economiza tempo e permite validar hipóteses de forma muito mais ágil.

O diferencial frente a outras IAs

A evolução recente da inteligência artificial tem focado muito na geração de imagens e vídeos. O Google, no entanto, está apostando em algo diferente: o chamado “visual computing”.

A ideia não é apenas mostrar algo, mas permitir que o usuário interaja com aquilo. É essa camada de manipulação que diferencia o Gemini de outras plataformas, que ainda priorizam representações mais estáticas.

Na prática, isso torna o Gemini mais útil em contextos onde explorar, testar e ajustar variáveis faz toda a diferença — como ciência, engenharia e educação.

Como acessar as simulações no Gemini

A funcionalidade ainda está sendo liberada gradualmente, mas a proposta de uso é simples.

O usuário deve selecionar o modelo “Pro” dentro do Gemini e fazer um pedido específico, como “mostrar um pêndulo duplo” ou “visualizar o efeito Doppler”.

Depois da resposta inicial, aparece a opção de ativar a simulação. A partir daí, é possível interagir com o modelo usando controles para girar, aproximar, pausar e ajustar parâmetros.

Essa combinação de explicação + experimentação transforma cada pergunta em uma experiência personalizada.

O começo de uma nova forma de usar IA

Com essa atualização, o Gemini deixa de ser apenas um assistente que responde perguntas e passa a funcionar como uma ferramenta interativa de exploração.

A mudança pode parecer sutil, mas representa uma nova etapa na evolução da inteligência artificial. Em vez de apenas consumir informação, o usuário passa a testá-la, manipulá-la e entendê-la de forma mais profunda.

Se a tendência continuar, o futuro da IA não será apenas responder melhor — será permitir que a gente veja, mexa e experimente o conhecimento.

[ Fonte: Infobae ]