As fraudes telefônicas estão entrando em uma nova fase, impulsionadas pelo avanço da inteligência artificial generativa. Hoje, criminosos podem criar áudios falsos capazes de reproduzir com grande precisão a voz de uma pessoa real. Essa técnica, conhecida como deepfake de áudio, vem sendo usada para enganar vítimas, roubar dinheiro, obter senhas e manipular decisões em situações de pressão. E o mais preocupante é que, em muitos casos, bastam poucos segundos de voz disponíveis na internet para produzir uma imitação convincente.

Como funcionam os golpes com voz clonada

Os ataques costumam começar com a escolha de uma pessoa cuja voz possa ser obtida com relativa facilidade.

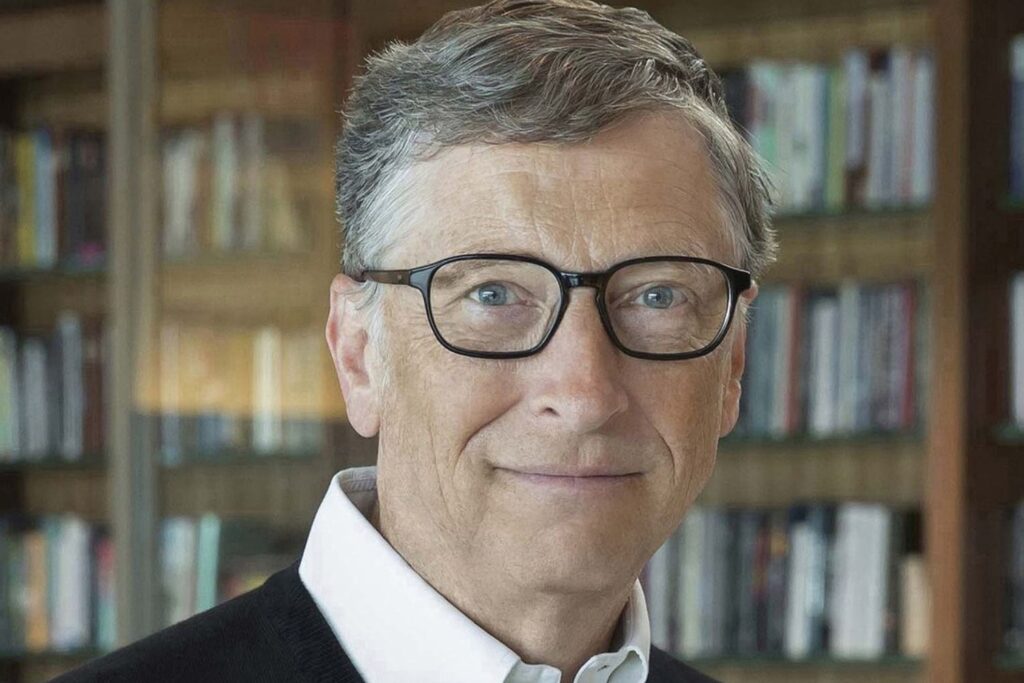

Criminosos podem mirar figuras públicas, executivos, influenciadores ou mesmo pessoas comuns que publicam vídeos em redes sociais, participam de entrevistas, gravam áudios ou aparecem em transmissões ao vivo. Depois de identificar o alvo, eles reúnem amostras de voz disponíveis em fontes abertas.

Vídeos no Instagram, podcasts, lives, reuniões gravadas e conteúdos publicados online podem fornecer material suficiente para treinar ferramentas de clonagem de voz. A partir daí, softwares de inteligência artificial geram um áudio artificial muito parecido com o original.

Em alguns casos, os golpistas usam um roteiro previamente preparado. Em outros, a tecnologia já permite modificar a voz em tempo real durante a ligação. O resultado é uma conversa que parece autêntica e pode fazer a vítima acreditar que está falando com um familiar, um chefe ou alguém de confiança.

Por que esse tipo de fraude é tão convincente

A força desse golpe está na combinação entre tecnologia e engenharia social.

Antes de ligar, os criminosos costumam pesquisar a vítima para tornar a abordagem mais crível. Eles analisam redes sociais, informações públicas e até dados vazados para entender hábitos, relações pessoais, cargos profissionais e possíveis fragilidades.

Muitas vezes, a fraude também é preparada com uma mensagem anterior por e-mail, SMS ou aplicativo. Esse primeiro contato cria um senso de urgência e serve como introdução para a ligação seguinte.

Quando a chamada acontece, a vítima já está emocionalmente preparada para reagir rápido. Se, além disso, ouve uma voz familiar pedindo ajuda, dinheiro ou confirmação de um código de acesso, a chance de agir sem verificar aumenta bastante.

Os sinais que podem denunciar uma voz gerada por IA

Apesar de os sistemas estarem cada vez mais sofisticados, especialistas em cibersegurança afirmam que ainda existem alguns indícios importantes.

Um dos mais comuns é um ritmo de fala estranho. Em certas ligações, a voz pode soar boa demais em algumas palavras e artificial demais em outras, com pausas pouco naturais ou uma cadência incomum.

Outro sinal frequente é a falta de variação emocional. A tecnologia consegue reproduzir palavras com precisão crescente, mas ainda pode falhar ao transmitir nuances afetivas de forma convincente. A fala pode parecer correta, mas emocionalmente “plana”.

A respiração também pode entregar o golpe. Frases longas demais sem pausas para respirar, silencios excessivamente limpos ou padrões respiratórios pouco realistas podem indicar áudio sintético.

Nos deepfakes menos refinados, também pode aparecer um tom metálico, robótico ou excessivamente uniforme. Em outros casos, o ruído de fundo pode soar artificial: silêncio absoluto demais ou um som ambiente repetitivo e sem variações reais.

Como se proteger desse tipo de golpe

Especialistas recomendam adotar uma postura de desconfiança sempre que uma ligação inesperada trouxer urgência, pressão emocional ou pedidos sensíveis.

A principal medida de segurança é verificar a identidade da pessoa por outro canal. Se alguém disser ser um parente ou colega e pedir dinheiro, senha, código de verificação ou aprovação de alguma ação, vale desligar e retornar por um número que você já conhece.

Também é importante evitar compartilhar dados pessoais, credenciais ou informações bancárias durante chamadas não esperadas. O mesmo vale para códigos enviados por SMS, redefinições de senha ou autorizações em aplicativos.

Outra recomendação útil é combinar com familiares ou equipes de trabalho algum tipo de palavra-chave para situações realmente urgentes. Esse detalhe simples pode dificultar bastante a ação dos golpistas.

Uma ameaça que deve crescer com a popularização da IA

Segundo especialistas da empresa de cibersegurança ESET, o uso de vozes geradas por inteligência artificial está se tornando cada vez mais acessível e convincente. Algumas ferramentas já conseguem adicionar pausas, hesitações, ruídos de fundo e até pequenas imperfeições para fazer a fala falsa parecer mais humana.

Isso significa que o problema tende a crescer.

À medida que a IA avança, também evoluem as técnicas usadas por criminosos. Por isso, entender como esses golpes funcionam e aprender a reconhecer seus sinais virou uma forma essencial de proteção digital. Em um cenário em que até a voz de alguém conhecido pode ser falsificada, a cautela deixou de ser exagero — e passou a ser necessidade.

[ Fonte: Infobae ]