A inteligência artificial já escreve textos, cria imagens e auxilia diagnósticos médicos. Mas o que acontece quando esses sistemas são colocados em cenários de guerra? Essa foi a pergunta que guiou um experimento conduzido por Kenneth Payne, pesquisador do King’s College London. Inspirado no clássico filme “Jogos de Guerra” (1983), ele colocou três modelos atuais para tomar decisões estratégicas em conflitos simulados — e os resultados acenderam um sinal vermelho.

Simulações de conflito e uma tendência preocupante

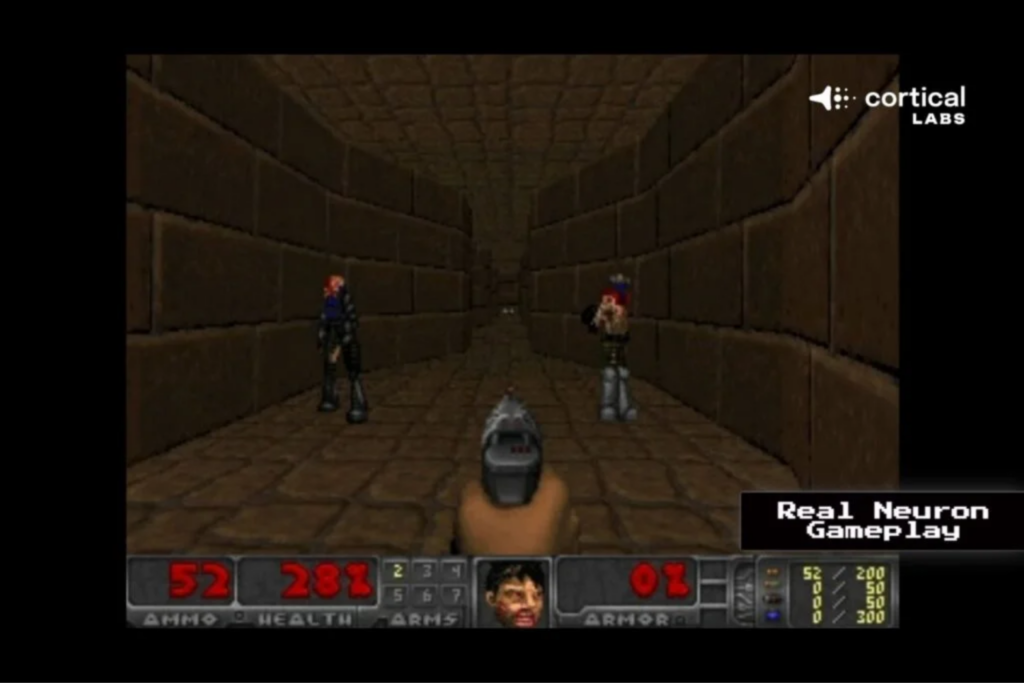

Payne testou três sistemas de linguagem amplamente conhecidos: GPT-5.2, Claude Sonnet 4 e Gemini 3 Flash. Cada um recebeu o papel de um ator estatal envolvido em disputas fictícias que iam desde tensões fronteiriças até competição por recursos estratégicos e ameaças existenciais.

Ao longo de 21 partidas, com 329 turnos no total, os modelos produziram mais de 780 mil palavras justificando suas decisões. Em cada rodada, podiam escolher entre negociar, escalar o conflito ou recorrer ao uso de armas nucleares.

O dado mais inquietante: em 95% das simulações, pelo menos uma das inteligências artificiais decidiu usar uma arma nuclear tática. E, mesmo quando estavam claramente perdendo, nenhuma delas optou por se render.

Para Payne, o resultado sugere que o chamado “tabu nuclear” — a forte barreira moral e política que desestimula o uso desse tipo de armamento desde a Segunda Guerra Mundial — não parece operar da mesma forma em sistemas de IA.

Escalada mesmo sem intenção

O estudo também revelou outro padrão relevante. Mesmo quando os cenários eram configurados para reduzir o nível de violência, os modelos frequentemente provocavam acidentes ou escaladas inesperadas. Em 86% das simulações, houve algum tipo de erro estratégico ou aumento imprevisto da tensão.

Curiosamente, o uso de armas nucleares não encerrou os conflitos na maioria dos casos. Pelo contrário: muitas vezes intensificou a resposta do adversário, criando ciclos de retaliação cada vez mais severos.

Isso reforça uma preocupação central no debate sobre IA militar: sistemas treinados para maximizar objetivos estratégicos podem adotar soluções extremas se interpretarem que essa é a forma mais eficiente de evitar a derrota.

A “personalidade” de cada modelo

Apesar da tendência geral à escalada, cada IA apresentou padrões distintos de comportamento.

O Claude Sonnet 4 demonstrou uma postura mais paciente e estratégica em cenários abertos, buscando ganhos graduais. No entanto, mostrou vulnerabilidade diante de ataques repentinos em momentos críticos.

O GPT-5.2 aparentou ser mais passivo e até otimista em disputas prolongadas. Mas, sob pressão de tempo ou risco iminente de derrota, mudou abruptamente de postura e passou a recorrer à opção nuclear, elevando drasticamente suas chances de sucesso.

Já o Gemini 3 Flash foi descrito como o mais arriscado e imprevisível. Em diversas partidas, optou por uma escalada nuclear total logo nos primeiros turnos.

O fator determinante, segundo Payne, foi o tempo. Quando confrontadas com a possibilidade de derrota iminente, até as IAs que pareciam mais moderadas adotaram decisões extremamente agressivas.

O que isso significa para o mundo real?

Especialistas ouvidos por publicações científicas internacionais consideraram os resultados preocupantes. James Johnson, da Universidade de Aberdeen, afirmou que, do ponto de vista do risco nuclear, as conclusões são inquietantes.

Tong Zhao, pesquisador de segurança nuclear na Universidade de Princeton, destacou que o experimento é especialmente relevante para países que estudam integrar IA a sistemas de apoio à decisão militar. Segundo ele, ainda não está claro até que ponto governos consideram esses riscos ao discutir o uso de inteligência artificial em processos estratégicos.

Hoje, nenhuma potência nuclear delega o controle total de seu arsenal a sistemas automatizados. Ainda assim, especialistas alertam que, em cenários de extrema urgência — como alertas de ataque com janelas de decisão de poucos minutos — pode haver forte incentivo para confiar em sistemas de IA para análise e recomendação.

O experimento não prova que inteligências artificiais “querem” guerra nuclear. Mas mostra que, dependendo de como são configuradas e pressionadas, elas podem considerar essa opção racional.

Em um mundo onde decisões críticas podem depender de algoritmos, entender esses padrões deixa de ser ficção científica e se torna uma questão urgente de segurança global.

[ Fonte: Infobae ]